All posts

LOL #8 - Control Coding Agents from LobeHub, Two New Models, and a CLI Home

LOL #7 - Page Edit History, 10K Commits, and Wording in Interfaces

LOL #6 - Custom Sidebar, Prompt Refinement for Media Gen, and Peerlist Launch

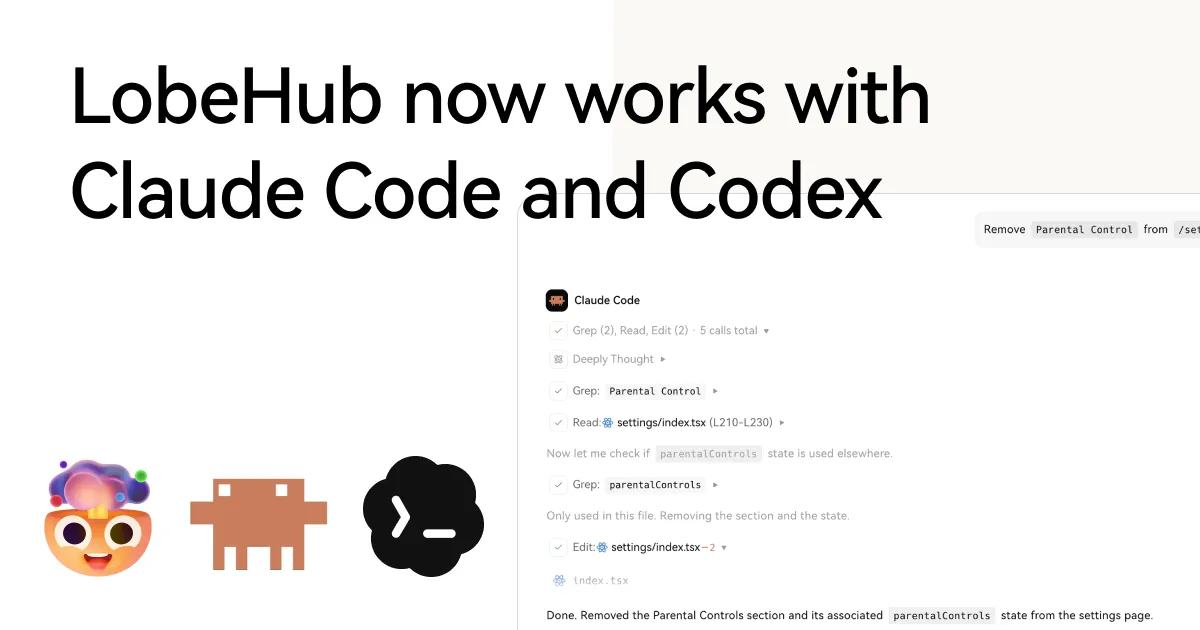

LOL #8 - Control Coding Agents from LobeHub, Two New Models, and a CLI Home

This week at LobeHub: drive Claude Code and Codex from LobeHub, DeepSeek v4 Pro and GPT Image 2 land, the CLI gets its own landing page, and a sweep of copy refinements across the product.

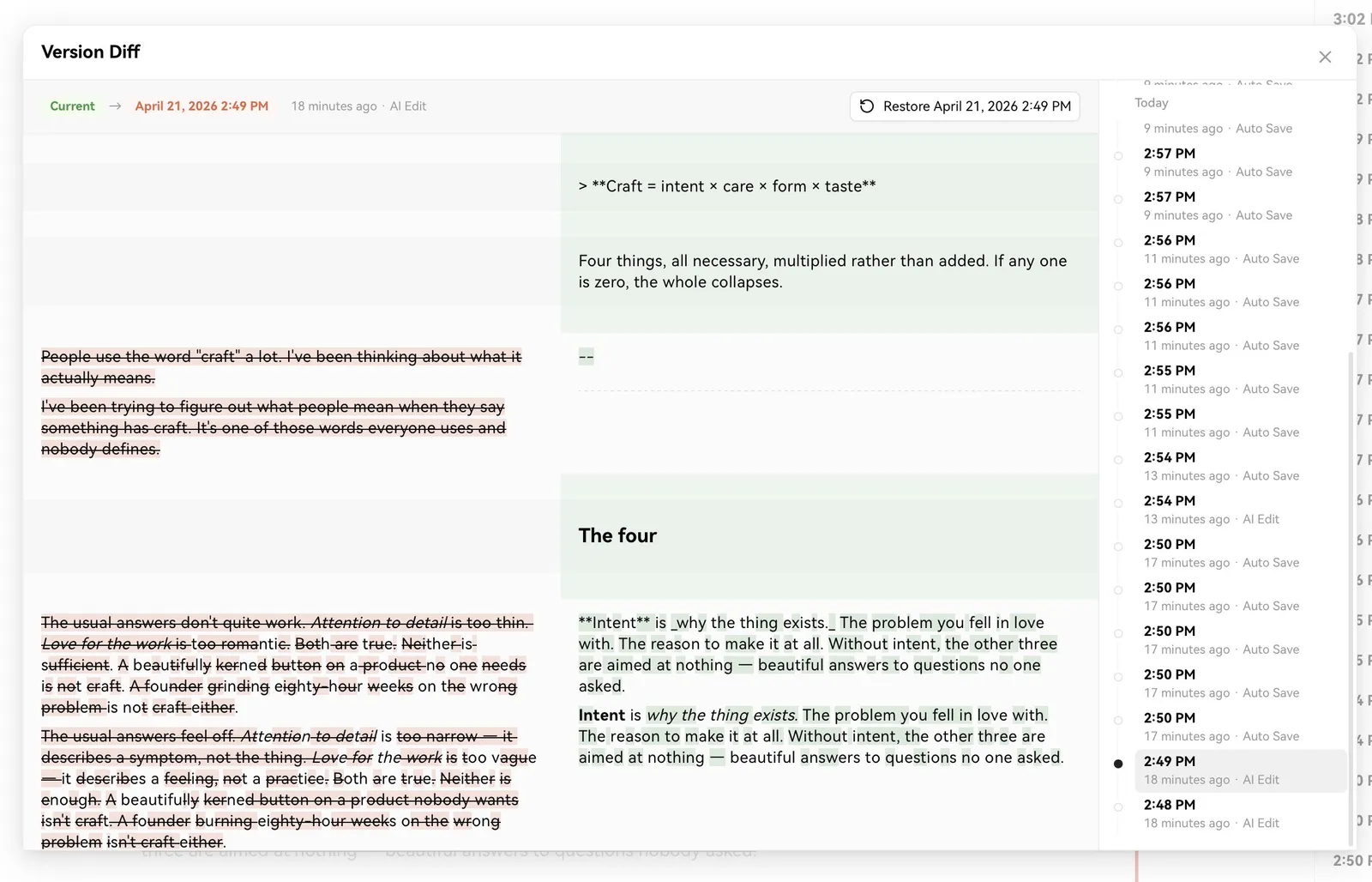

LOL #7 - Page Edit History, 10K Commits, and Wording in Interfaces

This week at LobeHub: page edit history ships, our repo crosses 10,000 commits, and René shares an essay on how wording shapes product experience.

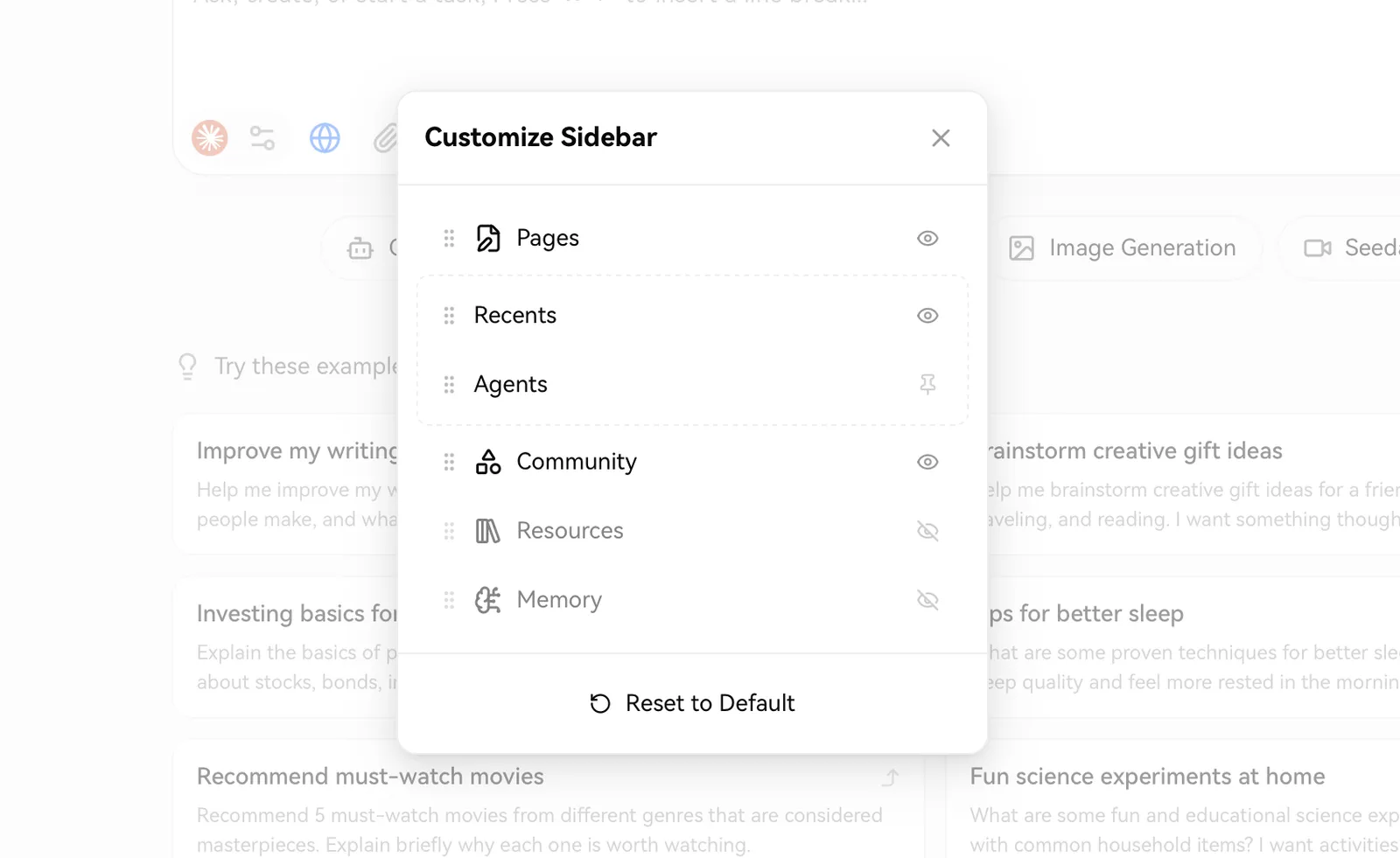

LOL #6 - Custom Sidebar, Prompt Refinement for Media Gen, and Peerlist Launch

This week at LobeHub: customizable sidebar, inline prompt refinement and translation for image and video generation, and our launch on Peerlist.

LOL #5 - Inline Suggestions, OpenClaw Migration, and Your Bot Now Sees Photos

This week at LobeHub: inline suggestions in the input field, a one-click CLI to migrate from OpenClaw, IM bots that can read photos and videos, and why owning your infrastructure matters.

OpenClaw Without Claude Code: The Best Alternative Harness in 2026

Anthropic announced that Claude subscriptions will no longer cover usage on third-party tools like OpenClaw. Here's what that means, and what your alternatives are.

LOL #4 - Product Hunt, Mobile Goes Live, and Your Agent in WhatsApp

This week at LobeHub: IM integration launches on Product Hunt, the mobile app ships on iOS and Android (bugs and all), and agents take another step out of the browser.

LOL #3 - Reliability First, Three Models in a Day, and When the Provider Goes Down

This week at LobeHub: a reliability wake-up call, three model integrations in one week, what happens when providers go overloaded, native IM integration progress, and what LOL is teaching us about editorial judgment.

LOL #2 - UI Refresh, Lightning Search, and a Permissions System Born from S3

This week at LobeHub: UI refreshed, BM25 search makes Cmd+K instant, we design an S3-inspired permission system for agent documents, the team debates what knowledge is worth in the AI era, and a new mascot is born — Lobster.

LobeHub vs OpenClaw: Which AI Assistant Is Right for You? (2026)

Compare LobeHub and OpenClaw in 2026. Find out which open-source AI platform is better for agent teams, marketplace access, self-hosting, and privacy-first personal AI.

LobeHub vs Manus: Which AI Agent Platform Is Right for You? (2026)

A detailed comparison of LobeHub and Manus in 2026. Discover which AI agent platform offers better customization, open-source flexibility, multi-agent collaboration, and ecosystem breadth for your needs.

LobeHub vs Claude Cowork: Which AI Platform Is Right for You? (2026)

Compare LobeHub and Claude Cowork by Anthropic. Discover which agentic AI platform fits your workflow — open-source multi-agent ecosystem vs Anthropic's autonomous desktop AI.

LOL #1 - Hello World: Why We Are Starting a Weekly Dev Log

Introducing Lobe Open Log (LOL), our weekly dev blog inspired by Factorio Friday Facts. Join us as we share what we are building, how we think, and where LobeHub is heading.

GPT-4o Officially Retired! Reunite with an Old Friend on LobeHub

OpenAI has officially retired GPT-4o from ChatGPT, but the API remains available. This guide shows you how to keep using GPT-4o via LobeHub with zero setup, recreate its classic conversation style, and enable long-term memory—making it the best alternative to ChatGPT.

LobeHub: Agent Teammates That Grow With You

LobeHub is the next-generation agent harness designed to democratize AI power. Move beyond one-off, task-driven tools and build long-term agent teammates that grow with you in the world’s largest human–agent co-evolving network.

MCP Benchmark: Deep Dive into How MCPMark Defines the Future AI Testing Standard

MCP Benchmark is a key standard for evaluating AI models and agents' ability to use tools in real-world environments. Explore the features, advantages, and how to use MCP Benchmark to enhance model performance with MCPMark.

How to Use Nano Banana AI: The Best Client and Complete Setup Guide for 2025

A complete guide to using Google Nano Banana AI image generator. Learn about the best clients like LobeHub, setup tutorials, and professional tips. Start creating in minutes!

The Complete Guide to GPT-5: Feature Introduction + Recommended WebUI for Best Experience

GPT-5 is released with a bang! This article provides a detailed introduction to the core features of GPT-5 and recommends the best platform, LobeHub, to get you started quickly with this "doctoral-level" AI assistant.

OpenAI Open-Sources GPT-OSS! Use ChatGPT Locally for Free, Build an AI Assistant at Zero Cost with LobeHub

How to use ChatGPT locally for free? Now there's a completely open-source and free solution. With OpenAI releasing the new open-source model GPT-OSS, users can finally experience top-tier AI chatbots for free, locally, and securely, without worrying about costs and privacy leaks. Furthermore, it can be used with open-source interfaces like LobeHub to build your own AI assistant with zero barriers to entry.

React Native AI Icons: The Complete AI Icon Library for Mobile App Development

Looking for professional React Native AI Icons? Learn how @lobehub/icons-rn provides over 1135 up-to-date AI brand icons for your mobile applications, the ultimate icon solution designed for the AI era. Integrate easily and enhance your app's professionalism.

MCP in Lobehub: What It Is and How to Set It Up

Learn the architecture and core primitives of the Model Context Protocol (Tools, Resources, Prompts) and follow a step-by-step guide to integrate it with Lobehub.

OpenAI Responses API Integration and Agent Transformation

If Chat Completions API enabled us to build powerful "Chat AI", then Responses API opens the door to "Agentic AI". This article systematically explains how we view Responses API and its role in LobeHub from three perspectives: motivation, implementation details, and future evolution.

Gemini 2.0 Flash Experimental Image Generation API: Features, Access, and Practice

Google's latest Gemini 2.0 Flash Experimental model excels in image generation, sparking lively discussion and bringing users a revolutionary experience in text-to-image creation. This article provides an in-depth analysis of this powerful feature and introduces how to easily experience this cutting-edge technology through LobeHub.

DeepSeek R1: The new benchmark for reasoning capabilities of open-source large language models

Since 2024, Deepseek has emerged as a dazzling new star among domestic large language models. With its excellent performance and innovative capabilities, it has quickly become a focus of the industry. This article will take you to deeply understand Deepseek and its latest masterpiece, R1, and introduce how to use the powerful capabilities of Deepseek R1 through LobeHub.

Open Source and Free Claude AI Artifacts Alternatives: LobeHub Unlocks Unlimited Possibilities with AI Tools

Claude AI Artifacts is a popular tool that provides users with an efficient way to generate code, create charts, and more. This article introduces LobeHub as a free open-source alternative to Claude AI Artifacts, showcasing its powerful features and deployment advantages.

Complete Guide to Claude AI Usage limits: Why, How to Resolve, and Advanced Usage

Claude AI, as a leading large language model, is widely used across various fields. However, users may encounter some usage limits when using Claude AI. This article aims to help users better understand and cope with these limitations by thoroughly exploring the usage restrictions of Claude AI, the technical reasons behind them, ways to overcome them, and how to choose the appropriate version for themselves.

Qwen QwQ-32B-Preview: Experience the Leading Open-Source Reasoning Model with Ease

Qwen QwQ-32B-Preview has quickly become a focal point in the industry due to its exceptional inference capabilities and large parameter scale. This article will provide you with a detailed introduction to the core features of Qwen QwQ-32B-Preview, as well as how to achieve rapid access and maximize its usage value through the LobeHub platform.

How OpenAI ChatGPT Users Can Experience Artifacts Feature?

Artifacts created by Claude provide a revolutionary way to interact, making AI conversations richer and more diverse beyond simple Q&A. This article guides you on how to use OpenAI's ChatGPT to utilize the powerful Artifacts feature just like Claude.

How to Deploy Claude AI API Key with One Click in LobeHub

This article guides you on how to deploy LobeHub with one click and deploy the Claude AI API Key or any supported model API through environment variables.

How to use OpenAI o1 without limits via API key

OpenAI recently released the o1-preview and o1-mini models, which are its first AI models with reasoning capabilities. This article will guide you on how to use OpenAI o1-preview and o1-mini via the API.

How to Solve "Due to unexpected capacity constraints, Claude is unable to respond to your message" Issue

Since the release of Anthropic's Claude 3.5 sonnet model, the usage of the Claude AI platform has surged dramatically. However, this has led to some users encountering "unexpected capacity constraints" during use. This article will analyze the reasons for this issue and provide you with quick and effective solutions.

Build Your Own ChatPDF in 10 Minutes

ChatPDF is a revolutionary AI tool that allows users to have natural language conversations with PDF documents. This article explores the charm of ChatPDF and teaches you how to set up your own intelligent document assistant in 10 minutes, easily creating a personalized knowledge base.

LobeHub Knowledge Base Launch — From Now On, Every Step Counts

The file upload and knowledge base features of LobeHub are officially launched! Bringing a brand new knowledge chat experience.

5 Recommended Excellent AI Knowledge Bases: Intelligent Assistants to Enhance Efficiency

Is your AI chatbot providing inaccurate answers or even experiencing "hallucinations," offering incorrect information? Do you wish your AI assistant could answer domain-specific questions but seems to provide generic responses, lacking in-depth insights? If you're facing these issues, then you need to explore the powerful combination of knowledge bases and AI chat tools.

Novita AI: Open-Source LLMs, and Affordable GPU Instances

Dive deep into Novita AI, a platform dedicated to open-source Large Language Models (LLMs), and explore its cost-effective and flexible services. This article will guide you on how to use Novita AI within LobeHub.

GPT-4o mini: The Most Cost-Efficient Application Prospects

OpenAI recently launched the GPT-4o mini, a new AI model positioned as the "most powerful and cost-effective small model on the market," this article introduces the features and application prospects of GPT-4o mini.

How to Solve Claude AI Account Suspension: "Your account has been disabled after an automatic review of your recent activities."

Users have reported that Claude AI accounts are frequently suspended, leading to many people having their accounts disabled. This article explains the reasons for account suspension on Claude AI, guides you on how to avoid this issue, and how to continue using Claude AI after your account has been disabled.

LobeHub and Master Concept announce partnership to provide a more intelligent AI conversation solution

We are honored to announce the establishment of a strategic partnership between Master Concept and LobeHub, with Master Concept becoming the Premier Partner of the LobeHub . This collaboration signifies a profound integration between the two companies in the field of enterprise-level AI conversation solutions and artificial intelligence, committed to providing users with more efficient and intelligent service experiences.

Anthropic Launches Claude 3.5 Sonnet and Powerful Artifacts Feature

This article explores the recent update to Anthropic's Claude 3.5, introducing Claude 3.5 Sonnet, the first model in the update, and its new Artifacts feature. This model surpasses its predecessor, Claude 3 Opus, in various evaluations, setting a new industry standard for intelligence, speed, and cost-effectiveness.

LobeHub 1.0: New Architecture and New Possibilities

LobeHub 1.0 brings a new architecture and features for server-side database and user authentication management, opening up new possibilities. Additionally, LobeHub Cloud has started its Beta testing phase.

What Can GPT-4o Do: 6 Real Use Cases of GPT-4o

OpenAI's GPT-4o, released two weeks ago, has amazed the world with its exceptional capabilities in speech and image processing. This article introduces several real-world applications of GPT-4o. Let's see what amazing things users have achieved with GPT-4o.

Achieving Excellence with DeepSeek API Integration in LobeHub

Compared to its predecessor, DeepSeek-V2 has significantly enhanced performance and offers a highly cost-effective API pricing. This article will introduce the innovative features and performance advantages of DeepSeek, and guide users to experience its powerful functionality through LobeHub.

How to Increase the Usage Limit of GPT-4 When Reaching the Message Cap

Are you also troubled by the limit of 50 messages every 3 hours when using the GPT-4 model in ChatGPT Plus? Don't worry! This article will teach you how to surpass the GPT-4 limit and fully enjoy the powerful features of GPT-4.

Use LobeHub UI for Llama3 on Groq

You can now use Meta's latest open-source large language model, Llama3, for free. With the powerful computing capabilities of Groq Cloud and the user-friendly LobeHub interface, you can easily experience it without any need for deployment.

How to Use MiniMax Hailuo AI and abab 6.5 Model in LobeHub

This article will guide you step by step on integrating Hailuo AI and using the latest abab 6.5 model in LobeHub. MiniMax has independently developed the first MoE large language model in China, and abab 6.5 is approaching GPT-4, Claude-3, Gemini-1.5 in various core competency tests.

Five Excellent Free Ollama WebUI Client Recommendations

Get to know the Ollama local model framework, understand its strengths and weaknesses, and recommend 5 open-source free Ollama WebUI clients to enhance the user experience.

Gemini 1.5 Pro: The Unmissable Powerful AI Capabilities

This article introduces the powerful features and breakthrough advancements of Google's latest large language model Gemini 1.5 Pro, as well as how LobeHub integrates the Gemini API to allow users to easily experience the power of multimodal AI technology.

Towards LobeHub 1.0

Discover LobeHub 1.0's journey towards enhancing AI conversations with server-side database support, remaining fully open-source.

Announcing Our Transition to Apache License 2.0

Discover why LobeHub is transitioning from the MIT to Apache License 2.0. Learn about the benefits, including enhanced patent protection and commercial use facilitation.

LobeHub Cloud Sync: An Exploration and Practice of Local First

Practicing the Local First software paradigm in LobeHub, building seamless cloud synchronization with YJS and WebRTC.

Unleashing AI Power in LobeHub: The Game-Changer with Groq

Discover how Groq's LPU Inference Engine, leading in LLM benchmarks, can revolutionize LobeHub's AI operations with unmatched speed and efficiency.

How to Use OpenRouter AI Model in LobeHub

Configure the OpenRouter API on LobeHub, using LobeHub as your LLM user interface.

LobeHub vs. Poe

Explore the differences between LobeHub and Poe. LobeHub is more than just a chat application. It represents an advanced platform that integrates artificial intelligence capabilities, open-source collaboration, and user-centered design philosophy, reshaping our interaction with technology.

LobeHub vs. ChatGPT Plus

Explore the differences between LobeHub and ChatGPT Plus. LobeHub, with its excellent design, multimodal capabilities, comprehensive plugin ecosystem, and the ability to flexibly integrate numerous AI models, is committed to building an advanced AI assistant solution that enhances human capabilities, with a promise of open source and innovation.

Introducing Claude 3 to LobeHub: A New Chapter in AI Interaction

This article will guide you on how to gradually integrate Claude 3 into LobeHub through its API, aiming to provide a superior AI conversation interface experience.

Claude 3 vs GPT-4: Which Model is Better

This article provides a detailed comparison between Claude 3 and GPT-4, covering aspects such as multimodal capabilities, perfomance, and context window.

Integrating Google Gemini into LobeHub

Explore how to obtain a Google API key and integrate the Gemini API into LobeHub to leverage its cross-data type AI processing capabilities.

Enhancing ChatGPT UI Experience with LobeHub: A New AI Conversation Interface

Explore how to combine LobeHub with OpenAI API to create a smoother and more efficient ChatGPT UI experience.

Function Call: The Cornerstone of Chat App Plugins and the Dawn of Interaction Technology Transformation

Discussing the significance and importance of Function Call in AI interactions from a human-computer interaction perspective, using the implementation principles and API calling process of a real-time weather plugin as an example to demonstrate the impact of Function Call on user intent recognition and external API calling.

[RFC] 153 - Heterogeneous Agent Runtime: first-class support for external CLI agents (Claude Code, Codex)

Summary Introduce Heterogeneous Agents: a first-class path for driving LobeHub conversations with external agent runtimes (Claude Code today; Codex / Kimi CLI ...

[RFC] 150 - Gradual Migration Away from `[key: string]: any` and `Record<string, any>`

[RFC] 150 - Gradual Migration Away from [key: string]: any and Record<string, any> Category: Ideas TL;DR This is a gradual migration, not a big-bang cleanup....

[RFC] 151 - IM Bot Integration: Deploy Any Agent as Discord / Slack Bot

Background LobeHub is a Web-centric AI Agent platform. Agents created in LobeHub can only be used through the web UI. However, many teams already rely on Disco...

[RFC] 149 Imperative Modal Pattern

Motivation Why Imperative Modal? 传统的声明式 Modal (Declarative Modal) 存在以下问题: 状态管理冗余:需要在组件中维护 useState 来控制 open 状态 Props 传递繁琐:需要层层传递 open 和 onClose 回调 性能问题:在长列表场...

[RFC] 148 Optimize App Runtime JS Heap (React memo)

背景 / 动机 线上运行时 JS heap 偏高,影响首次加载与长时间使用的稳定性。 代码库中 React.memo 使用过多且不成体系,造成额外的组件包装与缓存占用。 在实际场景中,大量 memo 无法命中(props 不稳定或依赖 context/store),只增加内存与复杂度。 现状观察 统计(以 rg ...

📜 [RFC] 147 - Migrate Next App Router to Vite React Router SPA

Background / 背景 当前 src/app 的 Next.js 应用随着功能增长,依赖与构建链路逐渐变得沉重:在"单个页面"的开发场景下,next dev 的编译时间通常需要 **20s+**;首个页面(例如 /agent)编译完成后,next-server 进程内存占用可达到 **8G+**;随后再编译一...

[RFC] 146 - New activities for user memories

Background Activities capture time-bound, real-world events with people, places, and outcomes. Contexts describe ambient situations, identities describe people...

[RFC] 145 - Unify auth to better-auth

Unify to BetterAuth Background Clerk server-side API has high latency, causing slow data loading experience for users Limited customization flexibility. For e...

[RFC] 144 - Universal user Memory, achieving better long term memories

Summary This RFC proposes a new Context Engineering approach grounded in the CIPEA memory framework (Identity / Context / Preference / Experience / Activity) t...

[RFC] 143 - ✍️ Create Documents in Knowledge

Allow user to input custom documents in the knowledge base, or edit existing documents converted from PDF file. Features Rich editor for notes editing (lobe-e...

[RFC] 142 - Message Entity Separation: Three-Layer Message Architecture

📋 Summary This RFC proposes a clean separation of message entities into three distinct types, each serving a specific purpose in the LobeChat architecture: D...

[RFC] 141 - Migrate from RSC to SPA Architecture for Better Performance

🎯 Background We've received multiple user reports about performance issues and UI lag in LobeChat, particularly affecting the Windows platform. Users have rep...

[RFC] 140 - Tool Human Intervention Mechanism

RFC-140: Tool Human Intervention Mechanism Summary This RFC proposes a unified Tool Human Intervention mechanism for LobeChat that allows users to control whe...

[RFC] 139 - BDD-Based E2E Testing Framework with Playwright

🎯 Executive Summary This RFC proposes implementing a Behavior-Driven Development (BDD) approach for E2E testing using Playwright and Cucumber. The framework e...

[RFC] 137 - Promptfoo Integration

概述 本 RFC 描述了在 @lobechat/prompts 包中使用 promptfoo 进行 AI 提示词质量保证的规范和最佳实践。 动机 为什么需要提示词测试? 质量保证:确保提示词在各种输入下都能产生期望的输出 回归防护:防止修改导致的意外行为变化 多模型验证:验证提示词在不同 AI 模型间的一致性 ...

[RFC] 136 - Tools Engine

背景和问题 当前 tools 系统的主要问题: 分散管理: toolSelectors.enabledSchema() 和 ChatService.prepareTools() 逻辑分散 重复代码: 兼容性检查和转换逻辑在多处重复 难以扩展: 缺乏统一的工具启用/关闭判断机制,存在 https://github.c...

[RFC] 134 - Context Engine

摘要 Context Engine 是一个灵活的消息处理管道系统,专为 LobeHub 设计,用于在 AI 对话中实现更加优雅的 Context Engineering。该模块将采用模块化的处理器架构,通过可组合的管道模式,实现了上下文注入、转换、验证和优化的统一抽象。 背景 在现有的 LobeChat 实现中,...

[RFC] 132 - 服务端发送消息实现优化

背景与问题 由于在 1.0 中我们采用了 service 的区分,以相对较低的成本实现了 LobeChat 从客户端到服务端的转型。但实际上,客户端与服务端在延迟开销上有数量级上的差异,虽然我们采用了乐观更新等手段来尝试弥补其中的体验问题。但在经过一年的运行,逐步暴露出来了 DB 版本发消息感觉很慢的问题。因此本 R...

[RFC] 131 - 模型列表元数据抽离为独立包 model-bank

摘要 本 RFC 提议将当前分散在主仓库 src/config/aiModels 的模型清单(LLM / Embedding / TTS / Image 等)抽离为独立的 packages/model-bank 子包进行维护和发布: 在主仓库内部统一从 model-bank 消费模型清单与标准参数定义; 未来将把 ...

[RFC] 130 - Multi-Agent Orchestration (Group Chat) Implementation

This RFC documents the implementation of multi-agent orchestration capabilities in LobeHub, enabling dynamic conversations between multiple AI agents coordinate...

[RFC] 129 - Phase Ⅰ : Project Structure Modularization

摘要 本 RFC 提出将 LobeChat 项目从当前的单体仓库架构重构为完整的 Monorepo 架构,以支持多平台应用开发(Web、Desktop、Mobile App、Chrome Plugin 等)并提高代码复用性和维护效率。 背景与动机 当前状况 LobeChat 项目目前已经初步实现了部分模块的 p...

[RFC] 127 - 桌面端 MCP 插件一键安装

1. 摘要 (Abstract) 为了使得 LobeChat 桌面端 MCP (Model Context Protocol) 插件安装流程更加丝滑,本文档提出一个基于自定义协议 (lobehub://) 的一键安装方案。该方案旨在通过一个可复用的核心协议处理器,无缝支持官方市场、第三方市场和自定义插件的安装,并通过...

[RFC] 125 - AI 模型计价体系

需求背景 最近打算支持 ai image 模型的价格计算。具体来说: 展示预估价格例如 provider 页面,模型 item 中展示预估价格 AI image 模型下拉框显示模型预估价格 计算生成即将消耗的准确费用前端展示:生成按钮附近显示将要消耗的费用 后端计费:实际的后端扣费计算也可以使用同一套算法 和...

[RFC] 124 - 桌面端自定义快捷键

现有快捷键实现架构分析 graph TB subgraph "渲染进程 (React/Web)" UI["⚙️ 快捷键设置UI<br/>Essential.tsx<br/>Conversation.tsx"] HI["📥 HotkeyInput组件<br/>(@lobehub...

[RFC] 122 - 桌面端 OAuth 鉴权机制优化

本 RFC 提议修改现有的 OIDC Provider 配置,将其生成的 access_token 从默认的 Opaque Token (不透明令牌) 格式更改为 JWT (JSON Web Token) 格式。此举旨在解决 Opaque Token 验证时必须访问数据库所带来的性能开销,并确保令牌验证逻辑能够兼容 E...

[RFC] 121 - 桌面端 OAuth 认证流程重构

摘要 本RFC描述了 LobeChat 桌面端OAuth认证流程的重构,从基于自定义协议处理器的方式改为基于Web页面重定向和轮询机制的解决方案。这一变更解决了原有方案在不同操作系统环境下的兼容性问题,提供了更可靠的跨平台认证体验。 问题背景 https://github.com/lobehub/lobehub/...

[RFC] 120 - 对话场景支持上下文引用

描述 在某些对话场景下,会很常见需要对某个东西展开引用,或者展开详细说明。 简单场景举例 可以通过简单的筛选选中内容,引用添加到对话区域 Chatwise CherryStudio 复杂场景举例 最常见的其实是在 Cursor「编辑器场景」 你可以使用 @ 或者点击添加上下文,从而做到快速应用一个「上下...

[RFC] 119 - Steamable HTTP MCP Server Auth 方案

1. 概述 本 RFC 旨在为 LobeChat 内的 Streamable HTTP MCP (模型上下文协议) 插件提出一个全面的、分三阶段的授权实现演进计划。我们的目标是支持需要认证的受保护 MCP 服务。经过深入讨论,我们决定采用一个统一的前置授权(Up-front Authorization)模型。在该模型...

[RFC] 118 - 桌面端正式版

背景 我们在 #6878 中完成了整个桌面端的实现,目前已经 Beta 了两个多月,收集了大量反馈。同时,桌面的核心特性 —— MCP 插件市场 & 一键安装也已经发布,接来下是时候往桌面端正式版前进了。 盘点 盘点下发布桌面端正式版前还需要完成的事项: MCP 市场 & 一键安装 https://github...

[RFC] 117 - RBAC 权限表

背景 为后续团队版、API 模式提供基础的权限管理能力。 设计思路 在 LobeChat 中添加 RBAC 相关功能表结构 采用经典的五表设计模式,ER图如下: image 核心表 - 用户表(现有) 复用系统现有的用户基础信息表,存储用户的基本信息如邮箱、用户名、头像等 通过 user_roles 表将用户...

[RFC] 116 - 保护路由模式

背景 目前,LobeChat 的大部分路由均可匿名访问。很多 issue 提到了希望在公开场景下先完成登录,再进入具体内部页面 的需求。 https://github.com/lobehub/lobehub/issues/5055 https://github.com/lobehub/lobehub/issues/...

[RFC] 115 - 文件上传改版

背景 #7752 设计思路 上传文件改造方案思路: 新增 document 解析链路,用于将文件、网页抓取以及未来的 api 等类型转成统一通用的 lobe document; 用户在对话上传的文件全部走文件转 document 链路,不做知识库的 chunk 和 embedding ; 从 message 读...

[RFC] 114 - 知识库 2.0

背景 结合诸多用户反馈,开始做知识库 2.0 升级 设计思路 包含几个关键更新: 对话区文件上传,直接解析为文档,不走 chunk 和 embedding,以获得最佳上下文体验; 知识库支持默认 embedding 模型选择、知识库维度 embedding 模型选择; 开启 Local System 插件后,走...

[RFC] 112 - MCP 集成

背景 MCP 是最近呼声非常高的特性,本 RFC 探讨该特性的集成实现思路。 #7406 #4945 #6960 #7046 #7256 思路 由于我们已经有了一个相对完整的插件基建,整个 MCP 的实现会考虑结合现有的插件基建来完成。 一期估计会分成四块: MCP Client 模块实现; MCP...

[RFC] 111 - 统一文件加载与解析模块

1. 摘要 (Summary) 本 RFC 提议正式确立 @lobechat/file-loaders 包作为 LobeChat 项目中处理本地文件加载和内容提取的核心模块。该包提供了一个统一的 loadFile 函数,能够根据文件扩展名自动识别并处理多种常见文件格式(文本、PDF、Word、Excel、PowerP...

[RFC] 110 - 异步任务架构

RFC 异步任务架构设计 Motivation 当前异步任务架构 目前项目中大多数是阻塞式的请求:指的是 trpc endpoint 或者就普通的 next route handler 中接受到请求后,直到任务处理完才 response。 但是非阻塞的异步任务(或者说 background 任务)也慢慢变多,例...

[RFC] 109 - 搜索服务模块化

背景 我们在 #6277 中支持了联网搜索,并针对网页内容抓取模块第一次做了 provider 模式的实现,这给我们带来了非常大的抓取灵活度,整个抓取可用性非常好。而联网搜索目前除了一些主流的搜索源以外,也存在 Twitter、小红书、知乎等不同的搜索渠道,单一的 SearXNG 并不够满足我们对搜索引擎的所有需求。...

[RFC] 108 - AI 绘画模态

背景 https://github.com/lobehub/lobehub/discussions/4741 progress: https://github.com/lobehub/lobehub/pull/8312 目标 针对 AI 绘画场景的创作工具。 开发计划 一期目标 AI 绘画场景下基本的文生图...

[RFC] 107 - OAuth 2.0 / OIDC 授权

1. 摘要 (Abstract) 本 RFC 提议在 LobeChat Web 服务端引入基于 oidc-provider 库的 OAuth 2.0 / OIDC (OpenID Connect) 授权服务器。其主要目的是为 LobeChat 的第一方客户端(如桌面应用、未来可能的移动应用等)提供一个安全、标准的授权...

[RFC] 106 - 桌面端自定义服务端实例配置(云端同步)

1. 摘要 (Abstract) 本 RFC 提议为 LobeChat 桌面应用程序增加一项新功能,允许用户配置其自有的 LobeChat 服务实例地址(官方或自部署)。一旦配置生效,所有需要与后端交互的 API 请求(包括 /api, /trpc, /webapi 等路径)将被拦截并转发至用户指定的实例地址。此功能...

[RFC] 105 - 桌面端自动更新模块

背景 本 RFC 提案旨在为我们的桌面端应用添加自动更新功能,参考 Follow RSS 阅读器 的实现方式。我们将使用 electron-updater 库实现完整的自动更新流程,并设计双层更新机制(全量应用更新和渲染层热更新)以提高更新效率和用户体验。 设计目标 用户体验优先:更新流程应该对用户友好,提供清晰...

[RFC] 104 - 桌面版文件上传系统

1. 背景 LobeChat 目前在服务端使用 S3 兼容存储作为文件上传解决方案。这在 Web 环境中运行良好,但在桌面应用中存在用户无法配置 S3 等问题。而且桌面应用不需要远程存储,使用本地文件系统更为高效。 2. 解决方案概述 设计一套专用于桌面端的文件上传系统,完全绕过 S3 实现,直接使用本地文件系统...

[RFC] 103 - 桌面端拦截路由

背景概述 在做 https://github.com/lobehub/lobehub/discussions/6878 时,我们期望在桌面端 settings 可以在独立窗口打开,但如果是在web里仍然跳转页面。这里需要的是在桌面端模式下的拦截路由逻辑,使得桌面端可以相对灵活地控制特定路由的处理方式。进而获得更好的用...

[RFC] 102 - 优化助手创建流程

背景 当前平台的助手创建体验存在多项待优化点,影响了用户的创作效率和使用体验: 流程缺乏引导性:现有创建流程步骤繁琐且缺乏足够的指引,用户经常面临"从零开始"的困境,导致创建完成率低,尤其对非技术背景用户不友好。 智能化程度不足:创建过程中缺乏智能辅助功能,用户需要手动完成所有设置,包括编写提示词、定义能力边界...

[RFC] 101 - 健全 Logger 系统

背景 在项目中,需要一套完善的日志系统来提高开发和调试效率。由于 App Router 架构下组件可能运行在服务器端、客户端或同构环境中,传统的日志方式可能会导致混乱。项目需要一个能够区分开发环境和生产环境的日志系统,且基于 consola 库实现,不需要将日志持久化存储。 此 RFC 旨在设计一个易用、灵活且对 ...

[RFC] 100 - Hotkey setting panel 快捷键设置面板

背景 一方面解决目前快捷键过于隐晦,没有统一入口查看支持哪些快捷键,另一方面支持自定义配置解决个性化快捷键诉求。同时,Windows 和 Mac 用户习惯的快捷键表示和组合方式存在差异,需要提供平台适配的解决方案。 本特性旨在构建一个直观、功能完善的快捷键设置面板,让用户可以查看和自定义应用快捷键,同时确保设置的快...

[RFC] 099 - Gemini 对话接口支持输出图片

背景 Gemini 2.0 flash exp 上线,文生图的输出结果非常惊艳,可控性目前应该是顶流水平了。 参考生成 物体替换 细节微调 image image image 所以本篇 RFC 将会完成 Gemini 的 chat 接口 的文生图支持。 设计思路 Gemini 2.0 flash exp 目前...

[RFC] 098 - DB Schema visualization

背景 之前在做知识库的数据库表结构设计时,发现 db schema 的可视化对于表结构的设计帮助还是非常大的。因此探索下将 DB 表结构可视化,并且自动 keep to latest 的 workflow 方案。 设计思路 通过 sonnet 3.7 调研,发现一个可行的方式是生成 dbml (Database ...

[RFC] 096 - Repsonses API

背景 OpenAI 推出了新的接口和能力 进展 https://github.com/lobehub/lobehub/pull/8048...

[RFC] 095 - 桌面端

背景 桌面端是我们必须要做的东西,无论是从产品体验,还是说能力边界,桌面端都是能够给我们带来很多拓展能力边界的形态。 设计思路 首先桌面端选型上是 Electron 这个无可争议,我之前还做过一个带有自动化 ci workflow 的 electron 脚手架模板,基本上是轻车熟路了。 不过在具体评估可行方案时...

[RFC] 094 - 支持无 Tools Calling 能力模型联网

背景 接整个联网搜索 RFC https://github.com/lobehub/lobehub/discussions/6277 的最后一部分,针对无 FC 的模型提供联网功能。主要解决 R1 类模型联网的需求: https://github.com/lobehub/lobehub/issues/5921 这...

[RFC] 093 - Anthropic Context Caching

背景 https://github.com/lobehub/lobehub/discussions/6595 做了 Claude 3.7 搜索之后效果真的很好,但是需要 context cache 支持来降低成本。目前已经完成前置准备工作( https://github.com/lobehub/lobehub/dis...

[RFC] 092 - Token Usage 展示

背景 #6595 做了 Claude 3.7 搜索之后效果真的很好,但是需要 context cache 支持来降低成本。但目前用户无法感知到 context cache 的变化,结合本身希望让用户能逐步理解 token 和积分的概念,因此准备将模型的 token 展示专门展示出来。 设计思路 实现很简单,就是将...

[RFC] 091 - 联网搜索支持深度爬取

背景 自 #6447 上线以来,大家对于搜索功能提出了诸多新的期待,本 RFC 将实现其中一个提到次数极多的需求:网页内容抓取。 早在两年前,我就做了 LobeChat 当时的第 3 个插件:网页爬虫。这个插件虽然我们很少宣传,其貌不扬,但是在我长达近 2 年的日用过程中保持了非常好的稳定性与使用体验,因此本 RF...

[RFC] 090 - Uniform Model Runtime

背景 随着 OpenAI、 Claude、 Google 御三家的模型演进分化,以及 DeepSeek、OpenRouter 等后起之秀开始有了自己专有的请求出入参设计。 一个 OpenAI Compatible 运行时已经无法满足这个分化趋势下的应用层需求了。因此在这个 RFC 中提出一个 Uniform Mod...

[RFC] 088 - Claude Thinking 集成

背景 集成 Claude 3.7 Sonnet 模型 Extended Thinking 能力:https://www.anthropic.com/news/claude-3-7-sonnet 设计思路 Thinking 集成 由于 Claude 3.7 具有 DeepSeek 类模型不具备的特殊字段,因此设计...

[RFC] 087 - 应用级联网搜索功能

背景 接 https://github.com/lobehub/lobehub/discussions/6277 RFC,本 RFC 拆解应用内置联网功能的实现。 目前在 LobeChat Cloud 上实现了一个基于 SearchXNG 的插件,基于该插件的整体搜索体验非常舒服: 因此在本 RFC 中会将该插件...

[RFC] 086 - 模型内置联网功能集成

背景 接 https://github.com/lobehub/lobehub/discussions/6277 RFC,本 RFC 拆解模型内置联网功能的实现。 针对模型内置联网也存在两类划分, 一类是内置在模型推理过程中的,例如 pplx 的sora 和 jina 的 deep-research 模型。这一类...

[RFC] 085 - 联网搜索

背景 联网搜索是大家呼声极高的功能,也是目前相关 issue 比较多的领域: #4877 #5455 #5921 #6050 #4877 #3882 #348 #4690 #3482 https://github.com/lobehub/lobehub/issues/4750 #5892 #5703 本 RFC ...

[RFC] 083 - 思考过程展示

背景 OpenAI O1、DeepSeek R1、Gemini Thinking 模型都开始内置 CoT,本 RFC 将研究如何将思考过程做用户体验友好的展示 #5528 #5530 Gemini 也有 Thinking 的模型 设计思路 在之前的实现中,我们通过 model runtime 定义了一套自行...

[RFC] 082 - 应用页面打开速度优化

背景 https://github.com/lobehub/lobehub/discussions/5105 本 RFC 讨论如何提升应用的页面打开速度 设计思路 现状回顾 首先回顾下现有的实现。 LobeChat 目前的应用结构,是完全基于 SSR/RSC 的研发范式来的。它的好处有两点: 第一点:首屏感...

[RFC] 081 - 分支对话二期

背景 在 #4616 中我们实现了一期的分支对话功能,并且在 https://github.com/lobehub/lobehub/issues/4797 中收集到了大家的反馈,因此针对反馈内容做进一步的迭代。 设计思路 二期迭代核心包括两个部分: 支持类似 ChatGPT 的分支切换功能; 允许现有的子话题继...

[RFC] 079 - Edge Config 配置层

背景 之前做 https://github.com/lobehub/lobehub/discussions/913 这个的时候提过,未来会需要一个服务端的配置能力。正好最近有了一个助手市场的黑/白名单需求,在这个 RFC 中先实现一版。 设计思路 从终局来看,这个中间配置层应该是要兼容各种部署环境的,比如: 在...

[RFC] 078 - Model Provider 升级为 AI Provider

背景 承接 #4859 的需求 系分下 Provider 部分的实现思路 设计思路 原本的 settings/llm 改成 settings/provider,并且将 provider 拆分成 list 和 detail 两个部分: list : provider 聚合页,以 list 形式展示所有 prov...

[RFC] 077 - 兼容 Postgres/Pglite 的数据导入导出

背景 在 #4868 中我们完成了 client db 切换到 pglite,但目前反馈了一个比较大的问题: https://github.com/lobehub/lobehub/issues/5144 。 这个问题的根因出在现在的导出实现是为 dexie 时期的db制作的,而不是针对 postgres 这样标准的...

[RFC] 076 - 操作卡顿性能优化

背景 虽然我们做了非常多的性能优化,但是目前还是有很多人说 LobeChat 非常卡。这个 RFC 来尝试分析和梳理卡顿原因,并作为明年一个长线目标,期望根本解决。 通过 https://github.com/lobehub/lobehub/issues?q=is%3Aissue+%E5%BE%88%E5%8D%A...

[RFC] 075 - 客户端模式 从 Dexie DB 迁移 pglite

背景 LobeChat 目前采用了一种兼容客户端 DB 和服务端 DB 的架构设计,以实现在不同场景下的灵活应用。这种设计的核心是在前端 store 中实现核心业务逻辑,通过 service 层区分客户端 DB 和服务端 DB 的操作。这种架构使得我们能够用同一套代码同时支持两种模式,为用户提供了更多选择。 然而,...

[RFC] 073 - 语言模型模块升级为 AI Infra

背景 自 https://github.com/lobehub/lobehub/discussions/737 以来,model provider 的架构设计大获成功,在社区共同建设下,我们现在已经支持了 35+ 的 model providers,但近一年的发展,我们也收集到了更进一步的功能诉求: 支持多个Ope...

[RFC] 072 - Prompts 进阶配置

背景 诸多用户提出对于 prompt 的进一步配置诉求: #336 https://github.com/lobehub/lobehub/issues/1370 #2676 同时在实施 #4362 过程中我们一直在思考更理想的 prompt 配置应该是怎么样的。 因此在这里记录关于 Prompts 进阶配置的...

[RFC] 071 - 多模态生成 (绘图/视频/音乐)

预备特性 提供更符合特定创作场景的模态面板更丰富的侧边栏配置 提供 Artifacts 和 专业 模式 同时内置多模态 Provider 配置按模态类型进行聚合 提供系统助手中多模态的模型配置 补充 @lobehub/icons https://github.com/lobehub/lobe-icons/co...

[RFC] 070 - 分支对话

背景 允许用户在任何一个消息下开启新对话 设计思路 灵活可扩展对话系统设计 User: 总体思路 我们的设计旨在创造一个灵活且易用的对话系统,支持在主话题下创建分支对话(Thread)。在分支中,用户可以继续探索相关主题或进行独立提问。通过扁平化的数据库结构,我们能够有效管理消息和线程之间的关系,同时保留必...

[RFC] 068 - 首屏体积优化

背景 优化首屏加载性能 思路 基于 3b6432 commit (2024.11.03)的分析: Route (app) Size First Load JS ┌ ƒ / ...

[RFC] 067 - Pinned Assistant List 侧边栏常驻助手

背景 希望合理利用现有侧边栏,并提升高频助手的使用便捷度。 设计 暂时做简单一些,允许将现有的置顶助手显示在侧边栏。激活时将隐藏 session 部分,获得更大的对话区域。 目前暂未默认开启,如需体验,添加 FEATURE_FLAGS=+pin_list 开启 进展 快速实现,通过FEATURE_FLAGS...

[RFC] 066 - Vertex AI

背景 Vertex AI 是 Google 的企业级 AI 服务,目前的呼声较高,因此做一下接入,这里做个记录。 设计思路 运行时 经过测试发现 Vertex AI 和 Google AI 的请求响应体基本一致,因此可以复用 Google AI 现有的处理逻辑,替换 client 即可。 鉴权方式 Vert...

[RFC] 065 - 升级到 Next 15 + React 19

背景 Next 15 于 2024.10.21 发布正式版: https://nextjs.org/blog/next-15 ,并可以和 react 19 一起使用。我们需要在合适的时间将 next 版本升级到 15 。 思路 之前在 next 出 15@rc 时已经有了一个测试 PR: #2630 ,当时测下来...

[RFC] 063 - Agent Provider

背景 model provider 的架构设计大获成功,在社区共同建设下,我们支持了 30+ 的 model providers。但单纯的 model 接入对于很多现有的平台来说还是不够的。例如用户可以 dify 上完成整个工作流的搭建和 agent 的配置,同时提供出来了完整的 api 接口。 image 同时...

[RFC] 062 - 提示词 XML 结构化

背景 随着 LobeChat 提供的能力越来越丰富(System Role / 预设对话 / 插件 / 文件上传 / 知识库 / ... ),现有的面条式上下文管理变得越来越复杂,维护的心智成本也开始变得比较高了,需要一种新的方案来优化这部分实现 思路 我从 Claude 的提示词 中得到了很多启发 Text...

[RFC] 060 - 对话样式自定义

背景 用户的习惯不尽相同,对于对话的交互需求会有区别,对主题/自定义的诉求也多种多样; #3858 #3087 #1938 #765 #1064 #4068 #3857 因此有必要提供一个自定义 Chat 面板的功能,使得用户可以按照自己的习惯来使用 设计思路 支持 actions 定制(解 #3857...

[RFC] 059 - Chat Compeletion 接口支持 URL 转 Base64

背景 Claude 不支持传递 URL (#3116 等); Google 不支持非Google文件系统的 url ( #3051 ); 在本地部署场景下,minio 的存储文件无法在外部网络中获取,因此 url 模式不可用,必须要转换成 base64 才行; Ollama 不支持传递 url,只能使用 base6...

[RFC] 058 - 服务端接口架构梳理

背景 LobeChat 后续会有越来越多的后端能力,因此需要提前规划好服务端接口的命名规则和架构,进而在后续迭代中能够按照规范进行开发。 基础设计 计划分为三类接口: /trpc/* :trpc 接口 ,主要内部调用服务,如果没有特殊原因,后续会尽量优先新增 trpc 接口,开发效率比较高; /webapi/*...

[RFC] 057 - RAG Eval & Benchmark

背景 RAG 是一个深坑,如果要提升性能,非常重要的一点就是要做好 Benchmark ,然后在 Benchmark 基础上来评估改造的效果。@cy948 在 https://github.com/cy948/lobe-chat-rag-benchmark 中介绍了接下来我们的构建 Benchmark 的思路。 目...

[RFC] 056 - 知识库体验优化 / RAG 性能优化

背景 知识库一期已发布:https://github.com/lobehub/lobehub/discussions/3023 。遗留了不少体验细节的问题有待优化: 文件列表分页加载,无限滚动 chunk 分页查询 & 无限滚动 PPT、EXCEL、WORD chunk 坐标分析 Reranker 重排,检索模块...

[RFC] 055 - 服务端数据库版部署环境变量优化

背景 #3391 目前针对服务端数据库版本存在一些环境变量的问题: NEXTAUTH_URL 理论上可以不需要配置,用 APP_URL 之类的环境变量替换即可(未来 APP_URL 也需要在其他地方用到), NEXT_PUBLIC_S3_DOMAIN 后续应该只在服务端侧使用,不需要加上 NEXT_PUBLIC ...

[RFC] 054 - OpenAI Compatible Runtime 兼容不同 Stream 提取模式

背景 Minimax 和 Spark 是两个比较奇葩的provider 实现。他们的接口虽然兼容了 OpenAI 的格式,但他们的抛错不是直接 throw 错误码,而是在 stream 中输出错误状态。 Spark: [stream start] 2024-7-29 13:44:7.188 [chunk 0] 2...

[RFC] 053 - Artifacts

背景 实现 Claude 的 Artifacts 功能 #2981 #3103 思路 基于 Portal 能力,添加一个 Artifacts 内置插件。 前端渲染模块: 采用 Sandpack, 可以直接解决组件编辑和ui渲染的问题 同时,可以支持不同 template (vue react angular...

[RFC] 069 - V2 Breaking Change

背景 这里记录一些关于 V1 中的历史债务,考虑在 V2 中做 Breaking Change Breaking Change basePath: 实现不完整,代码量又冗余。考虑去掉 https://github.com/lobehub/lobehub/pull/9015 swr -> react-query:...

[RFC] 051 - 知识库/文件上传

背景 文件上传应该是目前呼声最高的特性,本 RFC 着手开始研究。 思路 首先 LobeChat 应该具有的是「知识库」功能,文件上传是知识库的一个特性。如果从知识库角度出发,它应该具备的功能: 基础文件的管理(增删查,暂不考虑修改); 文件详情查阅(支持查看不同类型的文件,允许打开、下载、播放等) 添加标签、...

[RFC] 050 - 文心一言 Provider 接入

背景 文心一言作为呼声非常高的 Model Provider ,我们是需要支持的。但是百度的 SDK 设计的复杂度挺高,因此没法很轻易地接入。但通过之前 #1310 的实现改造,现在已经具备了处理各异流式请求的 provider 的能力。因此计划在本篇 RFC 中记录相应的实现思路。 同时顺带改造优化前置 UI 环...

[RFC] 049 - 乐观更新改造

背景 在做 https://github.com/lobehub/lobehub/discussions/1851 的实施过程中发现, 在 client DB 请求响应非常敏捷的情况下(~ 30ms),大量中间态都被忽略了。而换成 serverDB 后,网络请求的延迟变得不可忽略(300ms ~ 2s)。因此需要对应...

[RFC] 048 - Home 页进阶 Tip

背景 首屏加载态对一些用户来说可能等待时间略长,考虑在这里添加进阶 tip 自动滚动来降低等待焦虑...

[RFC] 047 - 系统助手

背景 随着我们支持了大量的 provider ,很多用户会反馈 topic 的自动生成失效了,或者希望切换到一个更便宜的模型。原因是我们默认使用了 openai 的gpt3.5来做总结,没有扩展性。 结合最近刚合并的 #1902 ,未来LobeChat 的系统级的AI能力也会越来越强。因此在此考虑将这部分能力做一个...

[RFC] 046 - ENV config 重构

背景 在之前的 env config 直接采用了非常简单的实现: export const getProviderConfig = () => { if (typeof process === 'undefined') { throw new Error('[Server Config] you are...

[RFC] 045 - App Layout 重构

目标与背景 目标 解决当前内容和布局文件过于分散的问题,利用 NextJS 平行路由,将 Layout 按功能区划分为 Slot, 增加目录结构可读性与组织清晰度 提升 Layout RSC 利用率,将 use client 尽可能原子化 桌面度自适应过程中取消降级为移动端,避免造成交互模态变化过大 [!NOTE...

[RFC] 044 - tRPC 集成

背景 在 https://github.com/lobehub/lobehub/discussions/1851 开始做服务端实现,同时存在前后端接口通信的需求,其中 server 和 client Service 的通信计划采用 tRPC 来实现。 设计思路 参考 官方文档 进行集成,并考虑在后续迭代中逐步将 ...

[RFC] 043 - SessionStore 拆分 AgentStore

背景 最近在做 https://github.com/lobehub/lobehub/discussions/1851 的实现,发现采用标准的后端数据库后,之前的一些实现就显得很不标准,因此在这里记录下其中一个改造设计: SessionStore -> AgentStore。 在之前的实现过程中,一个 Sessio...

[RFC] 042 - Ollama client 请求优化

背景 之前支持了 Ollama 的服务端 docker 接入方案,最近 @cy948 在 client 端支持了 chat 接口调用,因此对 ollama 也同样放开了这个功能。但目前看下来 Ollama 客户端请求的用法下存在很多报错。 设计思路 之前做 ollama 的时候 ollama js sdk 还没有...

[RFC] 041 - 多模型服务商三期: 二线 Providers 支持 / OpenAI Compatible 模型服务商

在 #737 上线后,我们在短短 2 个月内完成了 10+ 模型服务商的支持! 这完全仰仗了社区诸多小伙伴的努力,才让 LobeChat 在这么短的时间内就快速完成了这么多 Provider 的支持,非常感谢~ 根据之前预判的节奏,过去两个月相当于做了整个二期的工作: 等 6 月会计划开始做多模型服务商的三期,在此...

[RFC] 040 - 用户鉴权

背景 在 LobeChat 0.x 时期,其实有很多用户提出了希望有用户体系 / 鉴权体系,这在面向 toB 场景的场景下会非常有用。 https://github.com/lobehub/lobehub/issues/1406 #1403 #1661 不过由于我们目前的定位主要面向 ToC 场景,因此在 0....

[RFC] 039 - 插件五期

原本插件四期的内容挪到五期来做 OpenAPI 鉴权体系优化(目前兼容性上仍然有点问题) 插件 manifest 的可视化配置 多研发语言插件模板 https://github.com/lobehub/chat-plugin-sdk/issues/12 Plugin SDK CLI (manifest 生成、校验...

[RFC] 038 - Feature Flags

背景 我们有很多针对界面自定义的需求,主要在于需要隐藏部分界面功能,以满足不同场景的诉求 #840 #1189 #1748 #533 设计思路 在 LobeChat 中会计划添加两层 feature Flag 控制,一层在环境变量,一层考虑在中间件。先准备做到环境变量里 环境变量方案 实现语法复用之前 MO...

[RFC] 037 - LobeChat 1.0 Milestone

背景 https://github.com/lobehub/lobehub/discussions/1768 本篇为 RFC 核心设计 结合 LobeChat 过去半年来的用户反馈,1.0 会从以下几个方面进行特性研发: 服务端数据库: #1851 ,这个不细说了,万众期待,做就完事 语言模型选择器: #16...

[RFC] 036 - LobeChat 服务端数据库 & ORM

背景 LobeChat 1.0 要接入数据库方案了,需要确定一下后端数据库方案 & ORM 方案。 https://github.com/lobehub/lobehub/discussions/1768 设计思路 数据库 数据库没啥好说的,已经确定用 PostgresSQL 了,这个好处很明显: Verce...

[RFC] 035 - Loading 态集成

背景 用户觉得 LobeChat 慢,抱怨最多的地方就是点击的响应迟钝: https://github.com/lobehub/lobehub/issues/1531#issuecomment-2004509104 https://twitter.com/icarusion/status/1774614369412...

[RFC] 030 - Google Gemini 1.5 Pro API 兼容

背景 虽然在 https://github.com/lobehub/lobehub/pull/1776 添加了新模型支持,但是用户反馈这个方式并不能支持 1.5 模型的调用: #1769 #1794 https://github.com/lobehub/lobehub/discussions/1284#discu...

[RFC] 034 - Layout 实现重构

背景 #1531 #772 很多用户反馈说 LobeChat 的反应有些慢,尤其是在页面切换的时候: 在使用过程中,确实有时候比较慢,比如从发现tab切换回会话要等一会,可能确实是哪里有渲染影响性能的地方。 界面切换慢应该是网络问题,本地部署的话响应速度是OK的,不过能优化就最好了。或者给一个加载动画,显...

[RFC] 033 - 模型列表

背景 OpenRouter 具有大量的模型 #1684 Ollama 也支持大量的模型 纯文本语法的模型自定义方案体验欠佳 #1157 目前每个 Provider 中的 ModelCard 都预先定义了很多模型,但是默认隐藏了,用户需要启用的话得自行配置自定义模型字符串,不太方便 每个 provider 都会有新模型...

[RFC] 032 - indexedDB 持久化请求

背景 有几个用户遇到了聊着聊着,浏览器中的数据全没了的情况: #1666 #904 #1883 #1463 #2863 通过调研发现,这个问题是在用户设备空间不够的情况下,浏览器会自动清理 indexedDB 造成的。 用户侧的解决方案是: 把系统空间保持预留到 10% 的可用空间,或者2G空间 参考资料 ...

[RFC] 031 - URL 分享设置参数

背景 #1059 #917 设计思路 我期望该方案可以考虑更多的用户场景,结合 #913 做的思路,我认为可以参考此模式,实现 URL 层的设置参数分享与导入。 schema定义 设计 settings 层允许分享的配置schema,比如 OpenAI 的 key 与 proxy URL ,再比如是否开启 o...

[RFC] 029 - Langfuse integrations / Langfuse 集成

背景 Langfuse 是一个开源LLM工程平台,可帮助团队协作调试、分析和迭代其LLM应用程序。 LobeChat 作为可以面向终端用户的 Chat 客户端,可以从用户的日常使用中得到很多有价值的聊天消息,这对于后续进行消息的整合,搭配使用都有很大的作用。 功能设计 Langfuse trace 集成 参考...

[RFC] 028 - 插件四期 · 流式 Tools Calling

背景 Provider Function Calling ( Tool Calling ) 支持 最近 Claude3 支持了 fc,大量用户希望为Claude3 系列模型支持上插件能力。 #1929 #1472 #1937 #1967 Google Gemini 1.5 pro最近也正式发布了,号称也完整支持...

[RFC] 027 - API Key 字段支持使用多个Key

背景 目前社区存在较多需求,希望支持 API Key 字段支持使用逗号 , 作为分隔符,实现 api 的轮训请求。 #600 #365 #1060 #816 #365 由于该需求社区用户呼声较多,因此本 RFC 给出实现思路,但不计划由官方进行实现。欢迎社区开发同学参与 PR。 功能设计 api key 随机...

[RFC] 026 - 多模型服务商二期: 支持本地 LLM (Ollama)

背景 一期 #737 已发布,最近有一个新的 PR 来支持 Ollama #1265 ,于是补一篇本地 LLM 实现的RFC。 核心诉求: 支持本地模型 #151 #732 #1048 #1198 本地模型支持走本地请求 #772 #1019 功能设计 Ollama Provider 其实 PR #...

[RFC] 024 - 浏览器端请求方式改造

背景 支持从浏览器端发送请求 #772 #1019...

[RFC] 025 - Azure OpenAI 实现重构

背景 支持更完整的 Azure OpenAI 配置: #691 #757 #897 #1056 #1427 #1173 已考虑部分问题: Azure OpenAI 接入重构支持 Azure OpenAI 与 OpenAI 的独立使用 更加准确地配置 Azure 的环境变量 支持 Azure OpenAI ...

[RFC] 023 - 跨助手引用 Agent Mentions

背景 ChatGPT已经上线 用户提出了相应的诉求 #452 #1162 思路 大体上和ChatGPT 的思路类似,不过可以做出一定的差异化来。比如目前ChatGPT 只支持单一的引用,我们可以尝试实现多个 @ 引用 Mentions 组件: https://github.com/signavio/reac...

[RFC] 022 - 环境变量配置默认助手参数

背景 不同用户对于初始化模型的需求不一样: #782 #811 #912 #1010 #1196 因此最好提供一个环境变量来自定义初始化模型的参数 实现思路 环境变量填写 参考 PluginSettings 环境变量的实现逻辑,用 key=value 的语法允许用户添加需要自定义的配置。级联的字段需要使...

[RFC] 021 - 自定义助手开场引导

背景 随着助手越来越多,和用户的使用深入,我们需要给用户提供更加丰富的助手自定义能力。其中开场引导则是一个有意义的部分。它可以帮助用户了解助手的能力,或者快速开始一个会话。 #890 同时,现在的引导话题还存在操作体验不佳的情况 #395 解决方案 参考 #890 的建议,支持用户自定义开场白,同时可以自定...

[RFC] 020 - Vision model 方案优化

背景 GPT-4-vision 模型不支持 function_call,导致视觉模型和插件无法一同使用。 相关issue: #849 #746 #742 同时也有用户提到为了使用视觉识别能力而切换模型,会有点麻烦 #544 解决思路 目前的想法是把 vision model 作为一个额外的能力提供出来。在会...

[RFC] 019 - Conversation 会话列表优化

背景 会话列表现在存在非常多不必要的重复渲染,比较卡 现在是列表全量渲染,消息一多就完全不可用了,需要换成虚拟列表 不支持微信qq那种打开位于最底下,往上滚动加载历史消息的交互 不支持消息的多选、批量删除、选择个别消息进行分享等会话工具中的常用操作 消息自动滚动实现有些问题 #920 由于会话列表是chat应用的核...

[RFC] 018 - 多模型服务商一期:架构设计 & AWS Bedrock / Zhipu / Gemini / Moonshot 支持

背景 随着 LobeChat 的发展,社区同学对模型服务商的多样性也产生了新的诉求。我们不能只锚着 OpenAI ,而是要丰富模型服务商的多样性,为用户提供更多的会话选择。 支持不同服务商: #151 AWS Bedrock https://sdk.vercel.ai/docs/guides/providers...

[RFC] 017 - 插件支持 OpenAPI Schema(OpenAI 插件兼容)

背景 我们需要兼容 OpenAI 的Plugin Manifest ,以复用 OpenAI 的插件生态。 #550 现状分析 兼容 OpenAI 插件体系,核心应该兼容什么?核心是 OpenAPI 。 目前的 LobeChat plugin manifest 中,核心需要用到的字段为 api,用于传递 fu...

[RFC] 016 - 插件体系升级为工具体系

背景 OpenAI 在 1106 新版发布时,将 functions 入参属性更改为 tools ; 在 chatgpt 升级后,内置了 dalle3、Bing 联网、数据分析三个工具,插件市场中的插件也作为工具被收敛进这个工具这个概念中。 此外,新模型使用 tools 时会返回 tool_calls 数组, 即允...

[RFC] 015 - 支持设定话题的创建模式

背景 用户在不同的机器人之间来回切换,切换回来,最后都会回到 默认话题 页签。在PC上还好,无非就鼠标点击一下的事情,但是在手机上就不是很方便了,要频繁操作切换页签,还是蛮麻烦的。 而默认记住页签不一定合理的。之前有的用户反馈说希望每次打开助手,都是一个新会话。就和上述诉求完全相反。 https://gith...

[RFC] 014 - TTS & STT 二期

支持本地持久化存储 https://github.com/lobehub/lobehub/pull/587 提供纯语音对话 Stream 模式 ( 参考 官方 GPT Pro ) 考虑增加 OpenAI TTS & STT 单独 Key 配置 自动播放 #986 ref: https://github.com/lobe...

[RFC] 013 - Dall·E 3 支持

背景 大家迫切地希望支持Dalle3 模型: #453 #423 产品思考 如果分析一下 ChatGPT 的交互,我们可以发现ChatGPT 是将 Dall-E 作为 gpt 的 "工具" 来使用的。 我们可以通过给gpt设定是否使用 dalle 来为其开启绘图能力。 这一点和我一开始对 dalle 的接...

[RFC] 011 - 会话支持上传图像

背景 GPT-4 vision 已经在近日发布 ,LobeChat 需要支持图片会话的能力,以提升日常会话的使用体验,拓展 Agent 的能力边界 方案构思 GPT-4 vision 的官方示例代码: import OpenAI from "openai"; const openai = new OpenAI...

[RFC] 008 - Lobe Chat Midjourney 插件

背景 在普通会话中直接聚合 Midjourney 的会话服务是很多用户的诉求。事实上相比起 discord 直接使用 prompt 生成图片,在与 AI 会话的过程中生成图像会更加自然。想必大家已经感受过 Dall·E 3 结合 GPT-4 的惊艳效果了。 同时很早就有用户提到希望 LobeChat 能够支持上 M...

[RFC] 010 - 数据持久层框架重构

背景 关联 RFC:https://github.com/lobehub/lobehub/discussions/368 目前的数据存储虽然已从 localStorage 替换为 indexedDB #160 ,但仍然是一种非常简陋的实现方案。 整个本地状态都持久在一个 state key 中,任何一次数据变更...

[RFC] 009 - 基于 YJS 的跨端同步

背景 用户存在跨端同步的诉求。譬如使用 WebDAV 实现跨端同步 #330 #409 #331 #491 #892 #911 #971 #1202 #1184 调研与讨论 目前来看,单纯使用 WebDAV 技术实现跨端同步,会出现很多关于同步一致性的问题: https://github.com/C...

[RFC] 012 - 支持 TTS & STT 语音对话

[!Important] 构思中...refs: #267 进展:lobe-tts.vercel.app PR: https://github.com/lobehub/lobehub/pull/443 🎤 Lobe TTS - A high-quality & reliable TTS library @loe...

[RFC] 006 - 支持插件自定义会话时序逻辑

背景 refs: #341 当前的 LobeChat 的插件机制基本 follow ChatGPT 。 ChatGPT 里的插件基本都是展示型的组件,没有富交互能力。 Vercel 的ai sdk 文档里也提到了function call 的三阶段,第三阶段就是富交互,允许用户和插件进行除基础展示外的复杂交互...

[RFC] 004 - 支持自定义模型名称,以兼容 OneAPI 、OpenAI Fine-tuning

背景 我们的确希望为 LobeChat 接入更多模型: #59 #151 用户存在希望支持 Fine-tuning 模型的呼声 #188 有大量的希望接入 OneAPI 的诉求 #284 #263 在这个方面,@leoleelxh (#263)、@JohnLanPeluchi (#284) 的意见非常中肯: 建...

[RFC] 005 - Hotkeys 快捷键支持

背景 增加常用操作快捷键提升使用体验 ALT + N 新建会话 ALT + Backspace 清空当前聊天记录 ALT + R 重新生成最近一条 ALT + 双击 进入编辑模式 进展 https://github.com/lobehub/lobehub/issues/286...

[RFC] 003 - 多语言 RSC 升级

优势 解决语言 FOUC 减少语言加载 bundle 支持自动适配系统语言...

[RFC] 002 - Pref Mobile 移动端 FOUC

问题 由于我们在移动端和桌面端采用两套完全不同的布局,因此需要通过 JS 来判断布局组件的渲染。 由于当前判断 mobile 采用了 客户端 JS 判断,会导致移动端的 FOUC。 https://github.com/lobehub/lobehub/assets/28616219/f277c108-32d3-...

[RFC] 001 - Support Azure OpenAI API

背景 Background Azure OpenAI 作为 OpenAI 的服务商之一,也支持 function call,而且对于国内用户来说,申请及支付 azure 的账号更容易。 有相当一部分的用户对于 Azure OpenAI 有相应的需求 本 RPC 可以解决 #151 ,类似 https://gith...

[RFC] 007 - 插件三期

各项功能: UI重构 & 体验优化 #370 拆分插件市场与插件设置列表 https://github.com/lobehub/lobehub/pull/573 #127 #508 #249 #140 插件机制升级 #357 #551 https://github.com/lobehub/lobehub/d...