Ha pasado un mes intenso desde nuestra última entrega. Tres semanas en las que Apple ha lanzado Swift 6.3, ha anunciado la WWDC26, ha puesto freno a las apps de vibe coding en el App Store y ha dado de paso un empujón a todo el ecosistema de herramientas agentivas. Y mientras tanto, la comunidad no ha parado: nuevos libros, nuevas series educativas y un debate que no se apaga sobre qué significa realmente saber usar la inteligencia artificial en desarrollo. Vamos con todo.

Swift 6.3: el lenguaje sale del jardín

El 24 de marzo, Apple publicó Swift 6.3 y con él llegó uno de los movimientos más significativos de los últimos años: el primer SDK oficial de Swift para Android. No es un port experimental ni un hack de la comunidad. Es Apple proporcionando las herramientas para desarrollar programas nativos Android escritos en Swift e integrarlos en apps Kotlin o Java existentes a través de Swift Java y Swift Java JNI Core. Swift deja de ser un lenguaje exclusivo del ecosistema Apple para convertirse, oficialmente, en un lenguaje multiplataforma.

Pero hay más, y no poco.

El atributo @c: Swift habla C de primera clase

La novedad más técnica de Swift 6.3 es el nuevo atributo @c, que formaliza el viejo @_cdecl que muchos ya usábamos con cierto temor. Ahora puedes exponer funciones y enums Swift directamente a código C/C++ de forma limpia:

@c("MyLibrary_processData")

func processData(_ buffer: UnsafePointer<UInt8>, count: Int) -> Int32 {

// implementación Swift accesible desde C

}Combinado con @implementation, el compilador valida que la firma Swift coincida con una declaración preexistente en un header C, permitiendo reemplazar implementaciones C con Swift de forma gradual y segura. Para quienes trabajan en proyectos mixtos Swift/C++ o en frameworks multiplataforma, esto cambia las reglas del juego.

Module Selectors: el fin de la ambigüedad

Si alguna vez has tenido dos módulos importados con funciones del mismo nombre y has maldecido en voz baja, Swift 6.3 te trae module selectors con la sintaxis :::

ModuleA::getValue() // llama a getValue de ModuleA

ModuleB::getValue() // llama a getValue de ModuleB

Swift::Task { ... } // referencia explícita al Task de SwiftParece menor, pero en proyectos grandes con decenas de dependencias es una mejora de calidad de vida enorme.

Control fino del rendimiento para autores de librerías

Tres nuevos atributos para quienes construyen frameworks y paquetes: @specialize (preespecializar genéricos para tipos concretos frecuentes), @inline(always) (garantizar inlining en cada call site) y @export(implementation) (exponer el cuerpo de funciones en librerías ABI-estables para optimización cross-module). Son herramientas que no vas a usar todos los días, pero que hacen que tus dependencias sean más rápidas sin que tú hagas nada.

Swift Build, Testing y Embedded

Swift 6.3 incluye una preview de Swift Build integrada en Swift Package Manager: un motor de compilación unificado para Apple, Linux, Windows y Android. Todavía es preview, pero la dirección es clara.

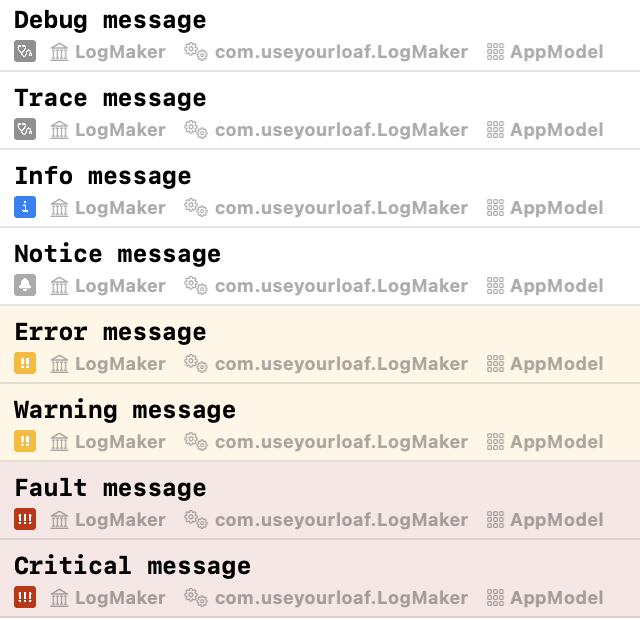

En Swift Testing, siete propuestas implementadas: warnings con severidad, cancelación de tests con try Test.cancel() y attachments de imágenes en Apple y Windows. Y en Embedded Swift, mejoras sustanciales: impresión de flotantes sin dependencias externas, los atributos @section y @used para control de layout en memoria, y mejoras de debugging en LLDB que permiten interpretar direcciones de memoria como tipos Swift con nombre.

Todo esto llega empaquetado con Xcode 26.4 e iOS 26.4, que además traen novedades en el Foundation Models framework: una nueva propiedad contextSize y el método tokenCount(for:) para gestionar la ventana de contexto de 4.096 tokens. El changelog completo en swift.org/blog/swift-6.3-released.

Y hablando de concurrencia —que Swift 6.3 sigue puliendo con region-based isolation ya en producción—, los chicos de Point-Free han arrancado una nueva serie sobre Isolation que merece mucho la pena. Tres episodios en marzo: Ep. 357: What Is It? define el concepto según las propuestas de Swift Evolution, Ep. 358: Legacy Locking explora data races y locks pre-concurrencia, y el Ep. 359: Modern Locking cierra el ciclo mostrando por qué NSLock sigue teniendo data races sutiles y cuál es la alternativa moderna. Si la concurrencia en Swift 6 te parece un laberinto, esta serie es el hilo de Ariadna que necesitas. Les perdonamos que crearán TCA por esto 😉

Malas vibraciones en el App Store

Mientras Swift 6.3 salía por la puerta grande, Apple cerraba otra con pestillo. A mediados de marzo se confirmó lo que muchos llevaban semanas sospechando: Apple ha bloqueado actualizaciones de Replit y Vibecode, las dos apps más populares de vibe coding —el término de moda para generar apps completas mediante prompts de lenguaje natural sin escribir una línea de código—.

El motivo oficial es la directriz 2.5.2 de App Review: las apps no pueden descargar, instalar ni ejecutar código que altere funcionalidades. Apple objeta que las apps generadas se muestren en web views embebidas dentro de la app. Replit espera aprobación si abre las apps generadas en un navegador externo; a Vibecode le han pedido eliminar directamente la funcionalidad de publicar en el App Store.

El contexto es revelador: el año pasado el App Store recibió 550.000 apps, muchas de ellas generadas con herramientas de este tipo. Apple ha decidido que la calidad importa más que el volumen, y está poniendo freno a la avalancha de apps de baja calidad que estaba saturando App Review.

En Apple Coding le hemos dedicado un vídeo que no se anda con rodeos: “Vibe Coding: la mayor estafa del desarrollo que ha roto el App Store”. Un análisis sin pelos en la lengua sobre qué ha provocado esta situación y por qué Apple ha dicho basta.

Y la reflexión que llevamos tiempo haciendo sigue siendo la misma: la IA sin criterio ni conocimiento no sirve para desarrollos complejos como una app móvil. Puedes generar código con un prompt, sí. Pero sin entender la arquitectura, los patrones de diseño, el ciclo de vida de una app, las guidelines de Apple, la gestión de memoria, la concurrencia... lo que obtienes es un castillo de naipes que se cae en cuanto sopla un poco de viento. Y Apple acaba de confirmarlo oficialmente.

Si estás en ese punto —ya sea porque quieres entrar en el mundo del desarrollo Apple o porque necesitas ponerte al día con Swift moderno, SwiftUI y las herramientas actuales—, el Swift Developer Program 2026 empieza el próximo 7 de abril y aún quedan plazas. Dos meses intensivos con Swift 6, SwiftUI con Liquid Glass y Xcode Agentic Coding, más 13 semanas de proyecto final guiado. Lo imparte Marc Hervera. Solo 40 plazas, financiación disponible. Es la formación más completa para convertirse en desarrollador iOS profesional, con los fundamentos que ninguna IA puede darte por sí sola.

El MacBook Neo, tres semanas después: récord histórico

Cuando analizamos el MacBook Neo en la newsletter anterior, las preguntas eran las de siempre: ¿puede un chip de iPhone mover macOS de verdad? ¿8 GB de RAM son suficientes? ¿Esto es un Mac o un juguete? Tres semanas después, los números han respondido con contundencia.

Tim Cook publicó el 20 de marzo que el Mac acababa de registrar su mejor semana de lanzamiento en nuevos usuarios de la historia de Apple. Aunque no mencionó el Neo por nombre, nadie tiene dudas de a qué equipo se refiere: el portátil de 599 dólares ha provocado lo que TechRadar ha descrito como “escasez al estilo iPhone”. A día de hoy, todas las configuraciones en Estados Unidos están agotadas online, con entregas estimadas en abril. TrendForce proyecta entre 4 y 5 millones de unidades vendidas en 2026, y Ming-Chi Kuo cifra entre 2 y 2,5 millones solo en el primer semestre.

Las reviews han sido una sucesión de sorpresas. Tom’s Hardware lo llamó “un game-changer a precio de ganga”, 9to5Mac dijo que es “un Mac verdaderamente bueno a un precio increíble”, y Macworld lo resumió en un “sorprendentemente bueno”. Los benchmarks cuentan la misma historia: 3.461 puntos en single-core —un 47% más rápido que el M1 y a solo un 6-7% del M4—, mientras que en multi-core iguala al MacBook Air M1. Macworld llegó a abrir 60 pestañas de Chrome con YouTube, Google Docs, hojas de cálculo y apps en segundo plano sin un solo beach ball. Los 8 GB, en uso real, están aguantando mucho mejor de lo que el papel sugería.

¿Y las limitaciones? Las que ya dijimos: para compilación sostenida, modelos de IA locales o trabajo multi-core intensivo durante horas no es el equipo adecuado. Pero para todo lo demás —y eso incluye a muchísima gente que nunca había considerado un Mac—, el Neo ha cambiado la conversación. IDC lo ha definido como “uno de los anuncios más importantes en la historia del Mac”, y los analistas coinciden en que está atrayendo a usuarios de Windows y Chromebook en números que Apple no había visto antes.

En Apple Coding le dedicamos un vídeo que se ha convertido en uno de los más vistos del canal: “Por qué el MacBook Neo funciona tan bien (y por qué te han mentido sobre los 8 GB)”. Desmontamos tres mitos persistentes —el chip “móvil”, los 8 GB como sentencia de muerte y la gestión de núcleos— con datos y sin rodeos. Si aún no lo has visto, pásate por YouTube y de paso suscríbete si no lo estás: es la mejor forma de no perderte estos análisis.

La comunidad agentiva explota (y necesita orden)

Marzo ha sido el mes en que el ecosistema de agent skills para Xcode ha explotado.

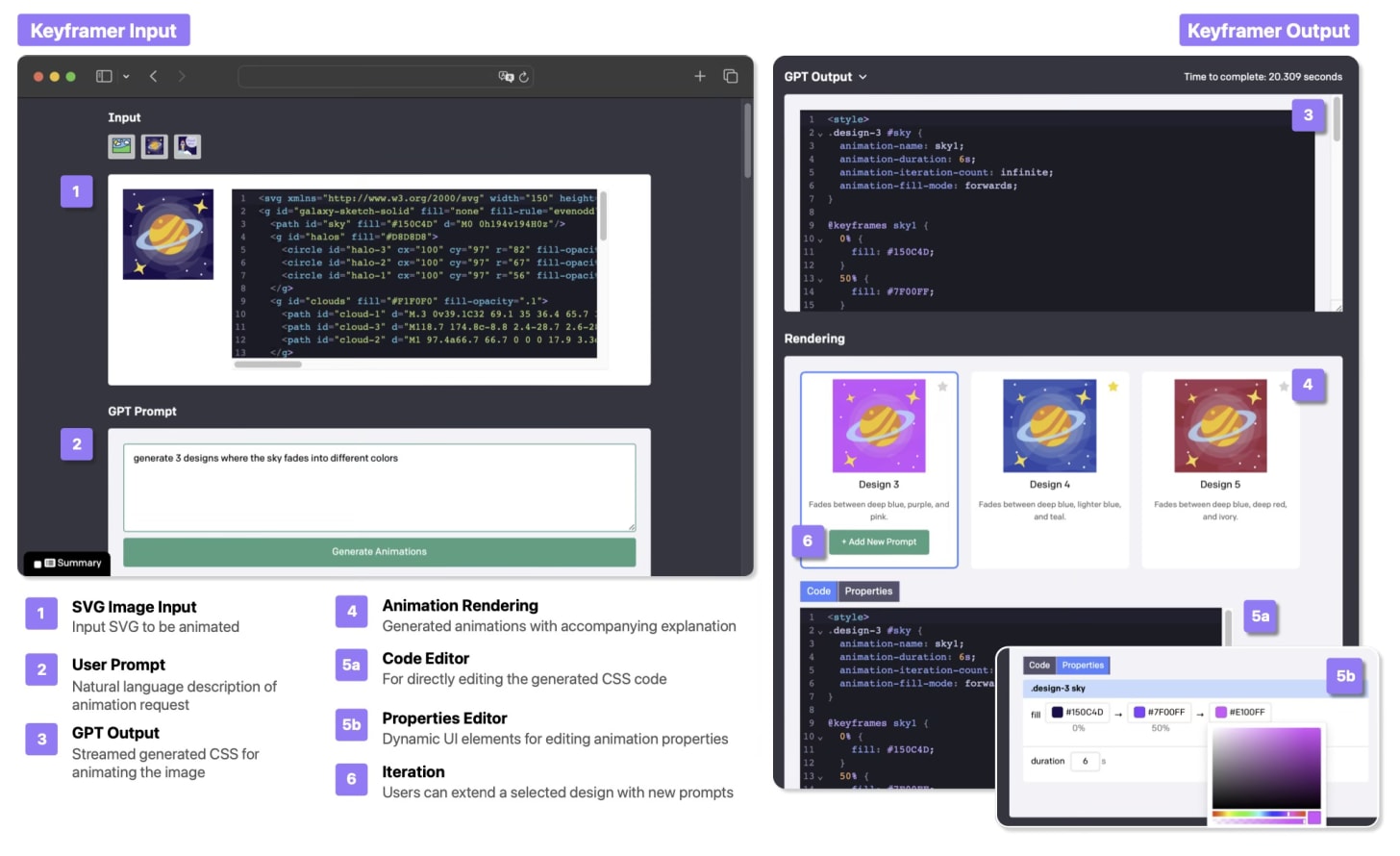

Paul Hudson publicó su SwiftUI Agent Skill, un skill open-source que identifica y corrige errores comunes que cometen los LLMs al generar código SwiftUI. En menos de una semana se convirtió en el skill más protagonizado en GitHub. Además, ha creado el repositorio Swift Agent Skills, un directorio curado de skills para la comunidad, junto con skills específicos para SwiftData y Swift Testing.

Antoine van der Lee, por su parte, lleva todo marzo publicando sobre desarrollo agentivo en SwiftLee: desde un framework de 9 pasos para elegir el skill adecuado, hasta los retos de trabajar con múltiples proyectos en entornos agentivos, pasando por cómo usar MCPs para optimizar productos con datos reales de Amplitude.

La tendencia es clara: el desarrollo agentivo ha dejado de ser experimental y se ha convertido en el tema dominante del ecosistema Swift. Pero hay un matiz importante que se pierde en la euforia: “usar IA” no es la habilidad. La habilidad es saber cómo usarla. Saber qué pedirle y qué no. Saber cuándo un agente te está ahorrando horas y cuándo te está metiendo en un agujero que tardarás días en salir. Saber diseñar los flujos, el orden, las herramientas.

Y ahí es donde entra el Swift Agentic Engineering Program. No existe ahora mismo ninguna formación que te enseñe esto con la profundidad que necesitas —y no lo decimos como opinión, lo decimos porque hemos mirado—. Este programa no solo te enseña cómo funciona la IA aplicada al desarrollo, sino que te da las herramientas, los flujos y el orden necesario para convertirte en la persona más productiva de tu equipo. Claude Code, Codex, Model Context Protocol, Foundation Models de Apple, agent skills... todo integrado en un programa de 60 horas en directo, con proyecto real. Es la diferencia entre usar la IA como un juguete y usarla como un profesional. Incluso crearás una app desde 0, un MCP, que será la memoria persistente de tus proyectos y tareas… nativa en Swift. Algo que nadie más tiene.

The SwiftUI Way: el libro que estabas esperando

Natalia Panferova —fundadora de Nil Coalescing y antigua miembro del equipo de SwiftUI en Apple— acaba de publicar The SwiftUI Way, y es un imprescindible.

El libro es una guía de campo para desarrolladores intermedios y avanzados que sienten que están “luchando contra el framework” en vez de trabajar con él. Cubre seis áreas clave: mentalidad composicional, modelado de dependencias de datos, optimización de actualizaciones de vistas, carga eficiente de datos, construcción de interfaces estables y performantes, y estilizado con convenciones de plataforma y accesibilidad.

Lo que lo hace especial no es solo el contenido —que es excelente— sino la perspectiva: Natalia trabajó en el equipo que diseñó las APIs de SwiftUI. Sabe por qué las cosas funcionan como funcionan, y eso se nota en cada capítulo. El precio es de 35 dólares con un sample chapter gratuito en la web. iOS Dev Weekly ya lo ha destacado en su Issue 746 como lectura recomendada. Si trabajas con SwiftUI a diario, hazte un favor y léelo.

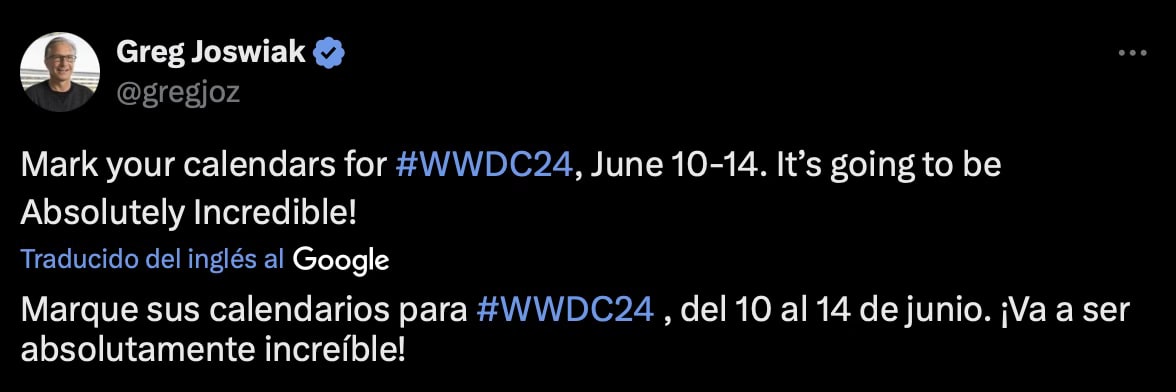

WWDC26: ya hay fecha

Apple confirmó el 23 de marzo que la WWDC26 se celebrará del 8 al 12 de junio. Formato principalmente online, con evento presencial en Apple Park el día 8. Los rumores más persistentes apuntan a que Apple presentará Core AI, un framework que reemplazaría a Core ML con soporte nativo para LLMs y modelos de difusión on-device. Si se confirma, será el cambio más importante en la estrategia de IA de Apple desde la introducción de Core ML en 2017.

También se anunciaron los ganadores del Swift Student Challenge 2026: 350 estudiantes (50 Distinguished Winners) que recibirán unos AirPods Max 2 y un año de membresía del Developer Program. Los Distinguished Winners visitarán Apple Park.

Y poco más

Ha sido un mes de los que marcan líneas en la arena. Swift 6.3 ha cruzado la frontera de Android y ha formalizado la interoperabilidad con C. Apple ha dicho “hasta aquí” con el vibe coding en el App Store. Y el ecosistema de desarrollo agentivo ha madurado lo suficiente como para que la pregunta ya no sea “¿debería usar agentes?” sino “¿sé usarlos bien?”. La respuesta honesta para la mayoría es que no, todavía no. Y por eso formarse —ya sea desde cero con el SDP26 o en agentivo con el SAEP— es la mejor inversión que puedes hacer antes de que llegue la WWDC26 en junio.

Si queréis dejarnos un comentario o contarnos cualquier cosa, estamos en los canales habituales.

Nos leemos pronto y hasta entonces: un saludo y Good Apple Coding.

¡Gracias por leer nuestra Newsletter! Nos vemos en Be Native.

]]>Apple cumplió lo prometido. En tres días —del 2 al 4 de marzo— llegaron el MacBook Neo, el iPhone 17e, el iPad Air con M4, el MacBook Air M5 y el MacBook Pro con M5 Pro y M5 Max. Sin keynote, sin escenario, pero con un catálogo renovado de arriba a abajo que hace semanas que no veíamos. Esta semana toca diseccionarlo todo: specs reales, precios finales en dólares y en euros, y —lo que más nos interesa— qué significa cada uno de estos equipos para los que vivimos de desarrollar en el ecosistema Apple.

Nota sobre precios: los precios en dólares son antes de impuestos, que varían según el estado de USA. Los precios en euros incluyen el IVA europeo (~20-25%).

La semana de los lanzamientos, producto a producto

El MacBook Neo (sí, ese nombre) es el protagonista más sorprendente. Un portátil con chip A18 Pro —el mismo que monta el iPhone 16 Pro—, pantalla Liquid Retina de 13 pulgadas, 8 GB de RAM unificada, conectividad Wi-Fi 6E y Bluetooth 6, y un diseño que recuerda más al iPad Air que a cualquier Mac anterior: sin notch, biseles uniformes, en cuatro colores (Silver, Blush, Citrus, Indigo). El precio de salida es 599 dólares / 699 € con 256 GB, o 699 $ / 799 € con 512 GB. En educación, desde 499 $.

El iPhone 17e llegó el 2 de marzo con chip A19, 8 GB de RAM, MagSafe integrado por fin en la gama “e”, cámara trasera de 48 megapíxeles con 2x zoom óptico, nuevo Ceramic Shield 2 y el modem C1X —hasta el doble de rápido que el C1 del 16e. Precio: 599 dólares / 699 € con 256 GB. Compatible con Apple Intelligence completa.

El iPad Air con M4 llega con el chip M4 y 12 GB de RAM (frente a los 8 GB del M3), chip N1 de conectividad (Wi-Fi 7 y Bluetooth 6) y soporte de modem C1X en los modelos celular. Precios desde 599 dólares / 649 € para el 11” Wi-Fi. Un 30% más rápido que el M3 en tareas CPU.

El Swift Developer Program 2026 es la formación más completa para convertirse en desarrollador iOS profesional: dos meses intensivos con Swift 6.2, SwiftUI con Liquid Glass y Xcode Agentic Coding, más 13 semanas y proyecto final. Lo imparte Marc Hervera, con una trayectoria que habla por sí sola. Solo 40 plazas, con financiación disponible. Comenzamos el 4 de abril. Infórmate en https://acoding.academy/sdp26.

El iPad estándar con A18 no apareció esta semana. Apple optó por no lanzarlo junto al resto de la gama. Los rumores apuntan a que llegará en los próximos meses.

Del Neo al Max: qué máquina necesita un desarrollador

MacBook Neo — El que abre la puerta ($599 / 699 €)

El MacBook Neo es perfecto para un perfil concreto: el que todavía no da el salto. Estudiantes, personas que quieren explorar el desarrollo Apple sin comprometer mil euros o más, profesionales de otros stacks que necesitan compilar una app de vez en cuando.

El chip A18 Pro tiene 6 núcleos CPU y 5 de GPU, con un ancho de banda de memoria de 60 GB/s. En Geekbench: 3.461 puntos en single-core y 8.668 en multi-core —superando al M1— en un portátil de 599 dólares.

¿Es suficiente para Xcode? Sí, con matices. Xcode arranca, las Previews de SwiftUI funcionan, los simuladores corren y puedes publicar en el App Store. Apple Intelligence está operativa. Los límites aparecen en proyectos grandes con muchos módulos, compilaciones limpias complejas o varios simuladores en paralelo.

Las limitaciones son claras: 8 GB de RAM no ampliables, un solo puerto USB 3 con DisplayPort, sin Thunderbolt, sin ProMotion, sin pantalla XDR. Sin SD, sin HDMI.

Para qué tipo de desarrollo es ideal: proyectos iOS/macOS de tamaño pequeño o medio, aprendizaje, apps sencillas, freelance a tiempo parcial, desarrollo web frontend.

MacBook Air M5 — El compañero de viaje ($1.099 / 1.199 €)

Aquí hay que ser honesto y decir algo que muchos análisis omiten: el MacBook Air M5 no tiene ventilador. Es completamente fanless. Y eso tiene implicaciones directas en el uso diario de un desarrollador.

En términos de chip, el M5 trae 10 núcleos CPU, 8 núcleos GPU (en el 13”), 153 GB/s de ancho de banda de memoria y 16 GB de RAM de base, configurable hasta 32 GB. Dos puertos Thunderbolt 4, MagSafe 3, Wi-Fi 7, batería de hasta 18 horas. El multi-core supera en un 80% al MacBook Neo en compilación paralela. Son números excelentes.

Pero sin ventilador, cuando el procesador se calienta bajo carga sostenida, el sistema empieza a limitar la velocidad de proceso —el conocido thermal throttling—. El Air es perfecto para una o dos horas de trabajo intensivo: una sesión de Xcode, una build limpia, unos simuladores abiertos. Lo maneja con soltura. Pero para un flujo de trabajo profesional de ocho o diez horas de compilaciones continuas y simuladores corriendo en paralelo todo el día, el Air M5 no es el equipo adecuado.

¿Para quién es ideal? Para el desarrollador profesional que trabaja principalmente en la oficina o en casa con un ordenador de sobremesa y lleva el Air como máquina itinerante. Para estar en una cafetería, en un tren, en una reunión. Para el freelance que trabaja en sesiones de una o dos horas. En esas condiciones, el Air M5 con 24 GB de RAM es probablemente el mejor portátil que puedes comprar por el precio. Pero si el Air va a ser tu único equipo y tu trabajo requiere sesiones largas de compilación diaria, necesitas el escalón siguiente.

MacBook Pro M5 — El equipo profesional de referencia ($1.699 / 1.899 €)

El MacBook Pro 14” con M5 es el equipo que más se vende en los departamentos de desarrollo de empresas en Estados Unidos y el que copa los servicios de renting tecnológico. Y hay razones concretas.

Para empezar, tiene ventilador. Un solo ventilador, pero activo. Eso significa que puede mantener el rendimiento durante horas sin throttling. El mismo chip M5 —10 núcleos CPU, 10 núcleos GPU, 153 GB/s de ancho de banda— que en el Air empieza a ceder bajo carga sostenida, en el Pro mantiene el rendimiento estable durante jornadas completas de trabajo.

Además, usa el mismo cuerpo y la misma pantalla Liquid Retina XDR con ProMotion a 120 Hz que los modelos M5 Pro y M5 Max. Y los puertos: MagSafe 3, tres Thunderbolt 4, HDMI, lector de tarjetas SD y jack de audio.

A partir de 1.699 dólares / 1.899 € (16 GB RAM / 1 TB), el MacBook Pro M5 ofrece capacidades de pantalla y rendimiento sostenido propios de las gamas Pro y Max, a un precio que, si lo comparas con el MacBook Air M5 configurado con 24 GB de RAM (ya en torno a los 1.300 $), el salto no es tan grande como parece.

Para qué tipo de desarrollo es ideal: desarrollo iOS/macOS profesional a tiempo completo en sesiones largas, proyectos de tamaño mediano o grande, trabajo con múltiples simuladores de forma continua, desarrollo server-side Swift y cualquier stack donde el portátil sea la herramienta principal del día.

MacBook Pro 14” M5 Pro — El salto a 128 GB ($2.199 / ~2.399 €)

Aquí cambia la arquitectura. El M5 Pro trae hasta 18 núcleos CPU y hasta 20 núcleos GPU, con hasta 128 GB de RAM unificada y 307 GB/s de ancho de banda —el doble que el M5 base—. Y tres puertos Thunderbolt 5.

Las compilaciones limpias de proyectos grandes —30, 40, 50 módulos SPM— se completan en menos de la mitad del tiempo que en un MacBook Pro M5 base. Para quienes trabajan en proyectos monorepo o equipos donde el tiempo de build impacta en la productividad, la diferencia se convierte en euros reales.

Para qué tipo de desarrollo es ideal: equipos de desarrollo iOS/macOS de tamaño medio o grande, proyectos con muchos módulos, desarrollo de SDKs y frameworks, Swift en servidor con carga real, proyectos multilenguaje, Python y data science de tamaño mediano, Docker con varios contenedores activos.

MacBook Pro 14”/16” M5 Max — El que no tiene techo ($3.599 / ~3.999 €)

El M5 Max con 40 núcleos GPU y hasta 128 GB de RAM a 614 GB/s introduce una arquitectura de dos chiplets (Fusion Architecture), primera vez en un portátil Apple, con Neural Accelerators en cada núcleo GPU.

Para ML y Core ML: entrenar modelos con MLX en el M5 Max es incomparablemente más rápido que en cualquier otro portátil. Para compilación pesada: proyectos con 100+ módulos Swift corren en local con tiempos de CI. Y, como veremos a continuación, antes de llegar aquí vale la pena hacerse una pregunta.

Un momento: ¿cuántas veces sales de casa?

Antes de hablar de Xcode y Swift, hay una conversación que vale la pena tener. Nadie la suele levantar —ni las marcas, ni la mayor parte de medios especializados— porque nadie tiene incentivo en recordártela. Es esta: los ordenadores de sobremesa siempre rinden más, cuestan mucho menos y casi nadie se para a pensar si realmente necesita un portátil.

El Mac mini M4 Pro —disponible hoy— tiene 24 núcleos CPU y hasta 64 GB de RAM por 1.399 dólares / 1.649 €. El Mac Studio M4 Max —también disponible hoy— tiene hasta 40 núcleos GPU y hasta 128 GB de RAM por 1.999 dólares. Y ambos pueden conectarse a la pantalla que ya tienes, trabajar durante años y nunca hacer throttling.

¿Por qué rinden mejor que un portátil del mismo chip? La respuesta es física: diseño térmico. Los sobremesa tienen ventiladores más grandes, más espacio para disipar el calor y no necesitan comprometer rendimiento por el peso o el grosor del chasis. El concepto se llama thermal headroom: cuánto margen tiene el sistema antes de empezar a reducir la frecuencia de los núcleos para no quemarse. En los sobremesa, ese margen es siempre mayor.

El Mac mini M5 Pro y el Mac Studio con M5 aún no han llegado —se esperan en los próximos meses—, pero cuando lleguen seguirán esta lógica: a igualdad de chip, el sobremesa siempre ganará en rendimiento sostenido y siempre costará bastante menos que el portátil equivalente.

Y el Mac Studio M3 Ultra actual —sí, Apple vende hoy un Mac Studio con M4 Max junto a otro con M3 Ultra, en un movimiento bastante inusual— tiene 28 núcleos CPU y hasta 192 GB de RAM por 3.999 dólares. Para ponerlo en perspectiva: eso es el precio de un MacBook Pro M5 Max de 14” con 36 GB de RAM. Con el Mac Studio M3 Ultra tienes más de cinco veces más RAM y un rendimiento bruto que ningún portátil puede igualar.

Por eso la pregunta que vale la pena hacerse, antes de gastarte 3.000 o 4.000 euros en un MacBook Pro Max, es: ¿cuántos días al mes trabajo fuera de casa? Si la respuesta honesta es “casi ninguno”, un Mac mini o un Mac Studio —combinado con un MacBook Neo o un MacBook Air para los desplazamientos— puede ser la solución más inteligente, más potente y más barata. Respetamos la decisión de quien prefiere el portátil, claro que sí. Pero conviene tenerlo sobre la mesa.

Si ya eres desarrollador con experiencia y quieres dar el salto a la codificación agéntica, el Swift Agentic Engineering Program arranca el 4 de mayo: 60 horas en directo con Claude Code, Codex, Model Context Protocol y Foundation Models de Apple, para multiplicar tu productividad como desarrollador nativo. Aprende a usar la IA tanto en la nube como 100% privada para proteger tu contenido en tu empresa. Bonificable por FUNDAE. Infórmate en: https://acoding.academy/agentic.

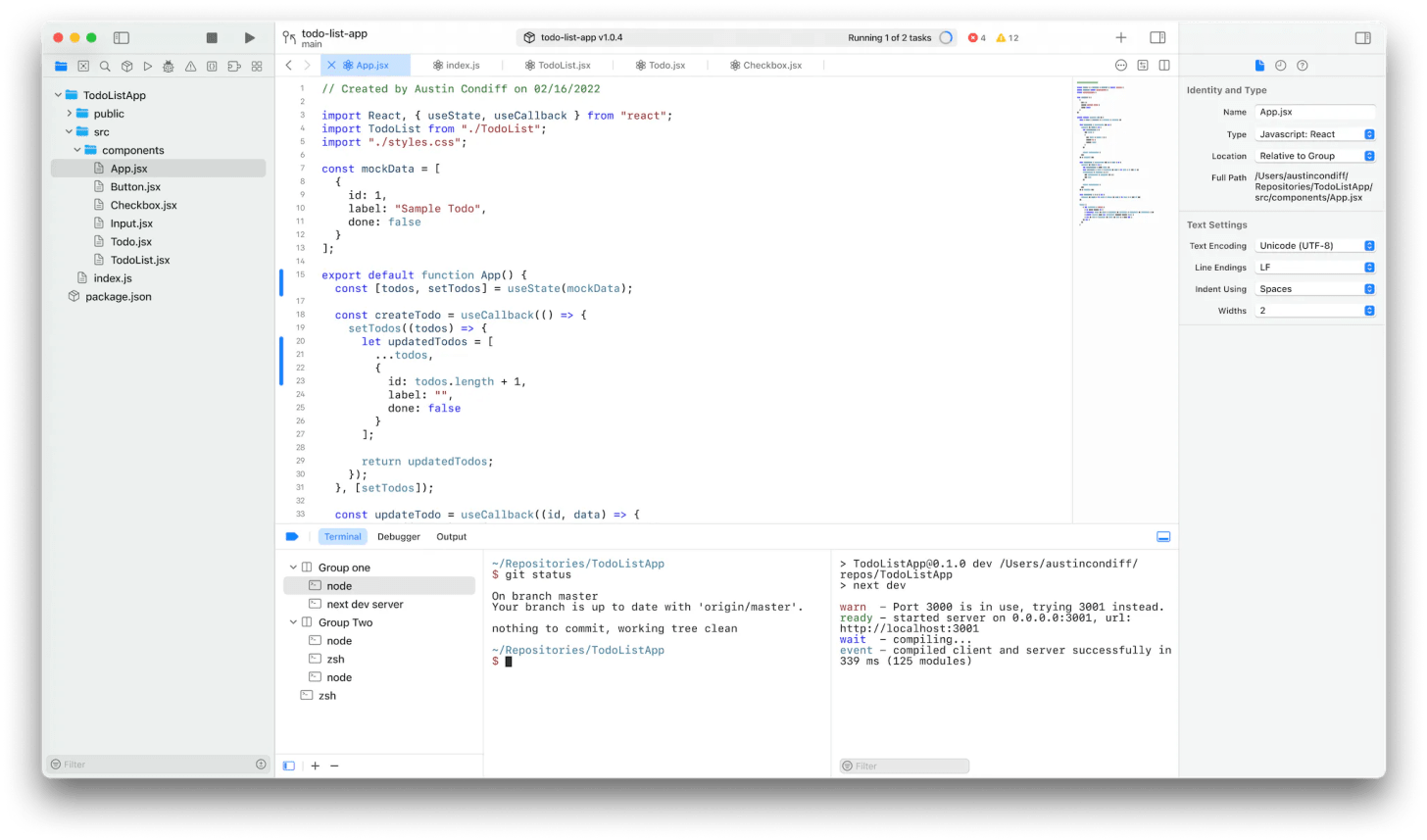

Xcode 26.3 y los agentes que ya viven dentro del IDE

El 26 de febrero, justo antes de la semana de lanzamientos, Apple publicó Xcode 26.3 con soporte para codificación agentiva.

Modelos de IA —con soporte inicial para Claude de Anthropic y Codex de OpenAI— pueden operar con autonomía dentro de Xcode: explorar la estructura del proyecto, leer documentación oficial actualizada, crear archivos, compilar, ejecutar tests, hacer snapshots de Previews y detectar errores, todo de forma autónoma. El protocolo es Model Context Protocol (MCP). Disponible para miembros del Apple Developer Program.

Swift en la semana de los lanzamientos

Aunque la semana ha estado dominada por el hardware, el ecosistema Swift no se ha parado. Dos publicaciones recientes que merecen la pena revisar:

El 2 de marzo, Swift.org publicó el resumen mensual: “What’s New in Swift: February 2026 Edition”. Recoge: el lanzamiento de Swift System Metrics 1.0, los nuevos paquetes GraphQL para Vapor y Hummingbird, SQLClient-Swift —acceso nativo a SQL Server desde plataformas Apple—, TuiKit para interfaces de terminal, el paquete FuzzyMatch para búsqueda difusa de alto rendimiento, la participación de Swift en el Google Summer of Code 2026 y las últimas propuestas de Swift Evolution aceptadas. Todo en swift.org.

Y el 6 de marzo, también en Swift.org, un caso de uso real: cómo el equipo de TelemetryDeck construyó su servicio de analítica respetuosa con la privacidad sobre Swift, Vapor y Kubernetes, procesando millones de eventos al día. Una de las mejores demostraciones públicas de Swift en producción a escala. Disponible en swift.org.

Apple Coding en YouTube y en Cuonda

Esta semana el equipo de Apple Coding ha estado muy activo cubriendo los lanzamientos desde primera hora. En YouTube (youtube.com/@applecoding) puedes encontrar los dos últimos vídeos publicados. Visita el canal directamente en youtube.com/@applecoding/videos para los títulos y URLs exactas.

En Cuonda, los dos episodios más recientes de Apple Coding Daily:

El episodio del 4 de marzo analiza la revolución de arquitectura de los M5 Pro y M5 Max: chiplets, Neural Accelerators en GPU y por qué esto no es una actualización incremental. Lo tienes en Cuonda.

El episodio del 6 de marzo se centra en el MacBook Neo: si es o no tu próximo portátil, a quién le sirve de verdad y qué compromiso implica frente al MacBook Air M5. Disponible en Cuonda.

El episodio que tienes que escuchar

El 8 de marzo, María Soriano y Julio César Fernández han publicado en el podcast de Apple Coding un episodio especial dedicado íntegramente a los productos que Apple acaba de lanzar. Una conversación honesta sobre cómo usan cada uno de ellos estos dispositivos en su día a día, qué recomiendan para cada perfil de usuario y su lectura sobre la situación actual del ecosistema Apple.

Un episodio de esos que escuchas caminando y llegas a casa sin darte cuenta. Lo tienes en YouTube.

Y poco más

La semana que acaba de pasar ha sido de las que quedan en la memoria del ecosistema. Desde los 599 dólares del MacBook Neo hasta los más de 3.900 del MacBook Pro M5 Max, Apple ha redibujado el catálogo completo en 72 horas —sin bajar el listón de calidad en ningún extremo—. El Neo es un Mac real, no un experimento. El Max es un monstruo real, no marketing.

Para los desarrolladores, la conversación más interesante no es “¿cuál es mejor?” sino “¿cuál necesito yo?”. Define tu flujo de trabajo antes de definir el presupuesto. La diferencia entre el Air M5 y el MacBook Pro M5 no es solo de precio: es de ventilador, de pantalla, de sostenibilidad de la carga de trabajo. Y si trabajas en casa la mayor parte del tiempo, quizás la pregunta real es si necesitas un portátil o un sobremesa. Esos detalles importan.

Si queréis dejarnos un comentario o contarnos cualquier cosa, estamos en los canales habituales.

Nos leemos pronto y hasta entonces: un saludo y buen código nativo.

¡Gracias por leer nuestra Newsletter! Nos vemos en Be Native.

]]>Cuando escribimos esto, quedan horas para que Apple empiece su “semana grande”. Sin keynote, sin escenario, pero con un catálogo de lanzamientos que promete sacudir el mercado: un MacBook de entrada con chip de iPhone, el esperado iPhone 17e, nuevos iPad y un MacBook Air renovado. Y mientras el mundo mira hacia Cupertino, Siri sigue escondiéndose entre bambalinas. Hay mucho que contar, así que arrancamos.

La semana que Apple se viste de colores

El 2 de marzo arranca lo que Apple tiene preparado como su gran semana de anuncios. Los comunicados llegarán de forma escalonada hasta el 4 de marzo, cuando eventos presenciales en Nueva York, Shanghái y Londres pongan la guinda. El menú es extenso:

MacBook de entrada con chip A18 Pro: el protagonista indiscutible. En colores —amarillo, azul, rosa, plata—, con pantalla de 12,9-13 pulgadas y a un precio estimado entre los 599 y los 799 dólares.

iPhone 17e: chip A19, MagSafe por fin integrado, cámara trasera de 48 megapíxeles y precio sin cambios en los 599 dólares.

iPad Air con M4 y iPad estándar con A18 —este último con soporte para Apple Intelligence por primera vez en la gama base.

MacBook Air con M5, con mejoras de rendimiento multi-core de hasta un 20% respecto al M4.

MacBook Pro con M5 Pro y M5 Max para quien necesita lo máximo.

Una semana grande. Y la novedad más relevante para quienes desarrollamos para Apple es, sin duda, la primera de la lista.

El Mac que puede cambiar quién desarrolla para Apple

Seamos directos: uno de los mayores frenos para empezar en el desarrollo Apple no es la curva de aprendizaje, sino el precio de la máquina de entrada. Durante años, la opción mínima recomendada ha sido el MacBook Air —estupendo portátil, pero con un precio de salida que supera los 1.100 dólares en la mayoría de mercados.

Eso está a punto de cambiar. El nuevo MacBook con A18 Pro llega con el mismo chip que el iPhone 16 Pro: CPU de 6 núcleos, GPU de 6 núcleos, proceso de 3 nanómetros de segunda generación y 8 GB de RAM garantizados. En benchmarks, el A18 Pro alcanza puntuaciones de single-core a la altura del M3 Ultra y multi-core superiores al M1 —sí, el mismo chip que inauguró la era Apple Silicon en el Mac—. En un portátil de menos de 800 dólares.

¿Es una máquina para usuarios profesionales exigentes? No, y hay que ser honesto con eso. Sin Thunderbolt —solo USB-C estándar—, pantalla más pequeña y sin ProMotion. Pero para correr Xcode, compilar proyectos reales, trabajar con simuladores y Previews, depurar y publicar en el App Store, es más que suficiente. Apple Intelligence funciona. El ecosistema completo de herramientas, también.

Junto al Mac mini —que sigue siendo la mejor opción de sobremesa por precio-prestaciones de todo el ecosistema Apple— tenemos ahora dos puertas de entrada al desarrollo nativo a precios que, por primera vez en mucho tiempo, compiten de verdad con alternativas de otras plataformas. Si tienes a alguien en tu entorno que quiera empezar a desarrollar para Apple y ha estado esperando el momento, esta semana puede ser el momento de decirle que ya no hay excusas.

iOS 26.4: la actualización que llegó sin su protagonista

La primera beta de iOS 26.4 aterrizó en manos de los desarrolladores a mediados de febrero, y la comunidad se lanzó a revisarla con la esperanza de encontrar señales de la nueva Siri. Resultado: nada. La Siri que prometía entender el contexto personal, buscar en mensajes antiguos, controlar apps de terceros con la voz... no está.

Según Bloomberg, las pruebas internas detectaron problemas serios: Siri responde demasiado lento en solicitudes complejas y ciertas consultas no se procesan correctamente. El equipo ha tenido que frenar. La nueva Siri podría llegar en iOS 26.5 —primavera— o incluso quedar para iOS 27 en otoño. No sería la primera vez que Siri se retrasa, pero la situación tiene un peso especial cuando los competidores llevan meses demostrando exactamente lo que Apple prometió.

En nuestro podcast le hemos dedicado 36 minutos a diseccionar qué ha pasado y qué significa todo esto para el futuro de Apple Intelligence. Lo tienes en YouTube y también en Cuonda, en el formato de Apple Coding Daily.

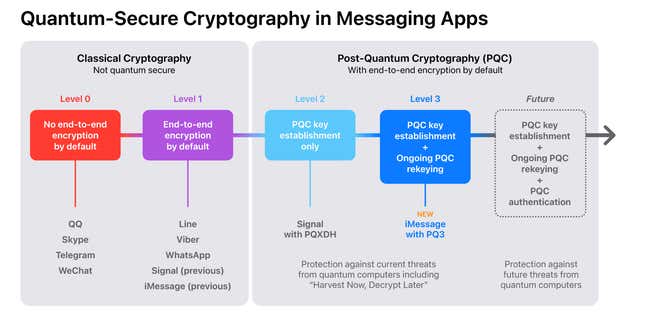

Ahora bien: que Siri no aparezca no significa que iOS 26.4 llegue de vacío. La actualización sí trae algo relevante para los desarrolladores: un nuevo modelo de fundación on-device —un LLM local completamente renovado— que mejora sustancialmente al anterior. Este modelo es el corazón de lo que Apple está construyendo: es la pieza que procesará el contexto personal del usuario, la que ejecutará comandos en las apps a través de App Intents, y la base sobre la que se apoyará la interpretación visual de interfaces, la misma que hemos visto en los papers de Ferret-UI. La arquitectura está tomando forma, ladrillo a ladrillo.

Esto tiene una implicación concreta si ya tenéis apps que usan el Foundation Models Framework: Apple ha pedido a los desarrolladores que revisen sus prompts e implementaciones con el nuevo modelo para asegurarse de que el comportamiento no varía de forma significativa. Y la razón es fundamental, no administrativa: la IA no es determinista. A diferencia de una función de código convencional, la misma entrada no produce siempre la misma salida. Un LLM calcula en cada paso el token más probable en el espacio de vectores, y esa distribución de probabilidades puede cambiar completamente de un modelo a otro según su base de entrenamiento. Un prompt que funcionaba perfectamente con el modelo anterior puede comportarse de forma distinta —a veces mejor, a veces inesperada— con el nuevo. Comprobadlo antes de que llegue a producción.

La IA siempre necesitará a alguien detrás del volante

Este contexto de promesas retrasadas da aún más relevancia a un artículo que publicó Julio César Fernández estas semanas y que no deberíais perderos. Con datos empíricos —no opiniones, datos concretos sobre las limitaciones técnicas actuales de los sistemas de IA—, explica por qué la inteligencia artificial seguirá necesitando humanos cualificados detrás. Y por qué, cuanto más sepas, más valioso serás en este entorno.

Lo tenéis disponible en X, en LinkedIn y en Be Native. Una lectura especialmente recomendable para quienes tienen dudas sobre si vale la pena seguir invirtiendo en formación técnica mientras la IA avanza.

Y hablando de lo que la IA sí puede hacer ya: Apple ha tenido un febrero muy activo en su división de investigación. El 17 de febrero publicó en machinelearning.apple.com dos trabajos que merecen atención.

Ferret-UI 2 es un modelo multimodal que entiende interfaces de usuario en múltiples plataformas —iPhone, Android, iPad, web, Apple TV—, combinando percepción de alta resolución mediante escalado adaptativo con datos de entrenamiento generados con GPT-4o. Pero la sorpresa del mes ha sido Ferret-UI Lite: un agente compacto de solo 3.000 millones de parámetros diseñado para ejecutarse completamente en el dispositivo, sin nube, sin latencia de red. Puede localizar elementos en pantalla con una precisión del 91,6% en ScreenSpot-V2 y navegar de forma autónoma por interfaces. El paralelismo con el trabajo de Siri es obvio —y prometedor. Todo el detalle en machinelearning.apple.com.

Swift en el navegador: BridgeJS alcanza el MVP

El grupo de trabajo de Swift para WebAssembly publicó a finales de febrero su resumen mensual, y hay buenas noticias en varios frentes.

La más destacada: BridgeJS ha alcanzado el MVP en la versión 0.44.1 de JavaScriptKit. Este nuevo mecanismo de interoperabilidad entre Swift y JavaScript permite declarar APIs usando macros Swift y generar código de puente bidireccional de forma automática. Con el atributo @JS expones tu código Swift a JavaScript; con @JSClass, @JSFunction, @JSGetter y @JSSetter importas el ecosistema JavaScript directamente en Swift. Y puedes incluso generar los bindings desde archivos TypeScript. Type-safe, eficiente y, por fin, cómodo.

Además, WasmKit avanza en el soporte del Component Model de WebAssembly —el estándar de modularidad del ecosistema—, y ElementaryUI incorpora @FocusState, la vista Group y un FilterModifier con blur, saturación y brillo, además de mejoras de rendimiento generales. Todos los detalles en el Swift Forums.

El backend Swift, en plena forma

El 16 de febrero, Jay Herron y la organización GraphQLSwift anunciaron en los Swift Forums el lanzamiento de dos nuevos paquetes: graphql-vapor y graphql-hummingbird. El objetivo: exponer una API GraphQL completa —con suscripciones WebSocket, cumplimiento de la especificación GraphQL-over-HTTP y un IDE GraphiQL integrado— con una sola llamada en tu router:

routeBuilder.graphql(schema: schema) {

// createContext()

}El framework se encarga de las codificaciones especializadas, el mapeo de errores a códigos HTTP y los protocolos de suscripción. Nada más que añadir.

En paralelo, el equipo de Vapor publicó su visión de futuro para Vapor 5: concurrencia estructurada completa (adiós para siempre a EventLoopFuture), integración con el servidor HTTP de Hummingbird, soporte de primera clase para OpenAPI, gRPC y streaming asincrónico, y observabilidad completa desde el primer día. Vapor 5 garantizará 3 años de soporte activo. El servidor en Swift sigue avanzando con paso firme.

Para desarrolladores: SwiftUI, Liquid Glass y lo nuevo de Apple

Febrero ha sido generoso en contenido oficial para desarrolladores. Algunas cosas que vale la pena revisar antes de que llegue la temporada de actualizaciones:

Las sesiones fundamentales de SwiftUI del 10 de febrero siguen disponibles en vídeo, tanto para principiantes como para desarrolladores con experiencia.

Las sesiones “Let’s talk Liquid Glass” continúan activas durante marzo. Si todavía no has explorado las APIs

glassEffect,GlassEffectContaineryglassEffectID, es el momento ideal para ponerse al día.La nueva documentación sobre optimización del Foundation Models Framework detalla cómo analizar el consumo de tokens y mejorar los tiempos de respuesta en apps que usan el modelo on-device de 3.000 millones de parámetros de Apple.

Todo disponible en developer.apple.com.

Convocamos el Swift Developer Program 2026

Una noticia que nos hace especial ilusión compartir: hemos convocado el Swift Developer Program 2026, la formación de referencia para convertirse en desarrollador Apple profesional, impartido esta edición por Marc Hervera —uno de los profesionales con mayor trayectoria y experiencia del ecosistema iOS en el mundo hispanohablante—.

Si aún no conoces a Marc, ahora tienes la excusa perfecta para hacerlo: tenéis la entrevista completa en YouTube, donde Julio César habla con él sobre su carrera desde los tiempos de Objective-C hasta la era de la IA. Si prefieres el audio, está también en Cuonda dentro del podcast de Apple Coding. Una conversación que merece una escucha tranquila.

Todos los detalles del programa, en acoding.academy.

Gabhel Studios: los que construyen Be Native

Y para terminar, queremos presentaros formalmente a Gabhel Studios (gabhel.com), el estudio de desarrollo responsable de Be Native y de muchas otras apps dentro del ecosistema Apple Coding, con más de 15 años de trayectoria en el desarrollo Apple.

Gabhel Studios ofrece desarrollo de apps iOS nativas con Swift y SwiftUI —código nativo siempre, nunca frameworks multiplataforma—; consultoría de inteligencia artificial, analizando flujos de trabajo reales e identificando herramientas de IA con impacto concreto; y modernización de apps legacy, con migraciones a Swift 6 con concurrencia estricta, adaptación a Liquid Glass y cumplimiento de la Directiva Europea de Accesibilidad.

Su filosofía se resume en cuatro palabras: “Código nativo o nada”. Más de 30 años de experiencia en proyectos reales, más de 10 especializados en consultoría de IA, y una honestidad que nos parece fundamental: si no pueden resolverlo, no cobran. Estamos muy orgullosos de poder ofreceros los servicios de un equipo así. Si tenéis un proyecto en mente, no dudéis en visitarles.

Y poco más

La semana que entra llega cargada. Nuevos Macs, nuevos iPhones, nuevos iPads, y con ellos nuevas puertas de entrada a un ecosistema que sigue siendo, a nuestro juicio, el mejor lugar donde un desarrollador puede trabajar. Swift no para: está en el servidor, está en el navegador, está en los dispositivos. Y nosotros estamos aquí para contarlo todo.

Si queréis dejarnos un comentario o contarnos cualquier cosa, estamos en los canales habituales.

Nos leemos pronto y hasta entonces: un saludo y buen código nativo.

¡Gracias por leer nuestra Newsletter! Nos vemos en Be Native.

]]>Llevábamos unas semanas sin pasar por aquí. La vida, los viajes, los compromisos... a veces conspiran para que la newsletter tenga que esperar. Pero si hay algo bueno de tomarse un respiro es que, al volver, tienes tanto que contar que no sabes ni por dónde empezar. Y esta vez, créenos, ha habido de todo: Apple abrazando la IA agéntica en Xcode, una guerra de modelos que se desató el mismo día a la misma hora, una aventura madrileña con evangelistas de Apple que nos dejó con la boca abierta, y un drama con renombramientos, estafadores crypto y langostas. Sí, langostas. Vamos allá.

Xcode 26.3: el IDE que ya no solo te ayuda, sino que trabaja por ti

El 3 de febrero, Apple dejó caer una de esas bombas que redefinen cómo trabajamos los desarrolladores. Xcode 26.3 llega con coding agéntico integrado de serie. Y no estamos hablando de un autocompletado glorificado: estamos hablando de agentes de IA completos, capaces de buscar documentación, explorar la estructura de archivos de tu proyecto, modificar configuraciones, verificar visualmente el resultado con Xcode Previews, iterar builds, solucionar errores y operar de forma autónoma.

¿Lo más interesante? Apple no ha apostado por un único proveedor. Xcode 26.3 soporta tanto a Claude de Anthropic como a Codex de OpenAI como motores de IA. Y por si fuera poco, integra MCP (Model Context Protocol), el estándar abierto que permite conectar cualquier agente o herramienta de terceros compatible. Es decir, Apple ha construido una autopista y ha invitado a todos a circular por ella.

Como dijo Susan Prescott, VP de Worldwide Developer Relations: “El coding agéntico potencia la productividad y la creatividad”. Y lo cierto es que, tras probarlo, cuesta imaginar volver atrás. Los agentes no solo escriben código: entienden tu proyecto, navegan por él, y proponen soluciones contextuales. Es un antes y un después.

La guerra de los titanes: mismo día, misma hora

Si el anuncio de Xcode 26.3 sacudió el mundo Apple, lo que vino dos días después fue directamente un terremoto en el mundo de la IA. El 5 de febrero, tanto Anthropic como OpenAI lanzaron sus nuevos modelos estrella. El mismo día. A la misma hora. Bueno, casi: Anthropic adelantó su lanzamiento quince minutos. Lo justo para poder decir que fueron primeros.

Claude Opus 4.6 (sí, el modelo que impulsa esta misma newsletter) llega con una ventana de contexto de 1 millón de tokens en beta —cinco veces más que su predecesor—, un sistema de Adaptive Thinking que decide cuánto razonar según la complejidad de la tarea, y la función estrella: Agent Teams, que permite que múltiples instancias de Claude trabajen en paralelo coordinándose entre sí. Para demostrar su potencia, Anthropic construyó un compilador de C completo usando un equipo de Claudes trabajando en paralelo. Sin intervención humana. Ahí queda eso.

En cuanto a rendimiento, Opus 4.6 marca un 72,7% en OSWorld (frente al 66,3% de Opus 4.5), un 65,4% en Terminal-Bench 2.0 y un 80,8% en SWE-bench Verified. Pero donde realmente brilla es en la mejora de búsqueda web (+16 puntos) y operaciones de terminal (+5,6 puntos). Y todo esto manteniendo el mismo precio: 5/25 dólares por millón de tokens de entrada/salida.

Por su parte, GPT-5.3-Codex llega como modelo unificado: OpenAI ha dejado de separar los modelos de código de los generalistas. Es un 25% más rápido que su predecesor, soporta 400K tokens de contexto y 128K de salida, y tiene un dato que da vértigo: es el primer modelo de OpenAI que ayudó a crear su propia versión. Literalmente, versiones tempranas del modelo depuraron su propio pipeline de entrenamiento. Sam Altman además señaló que es el primer modelo que alcanza la clasificación “alta” en ciberseguridad dentro de su framework de preparación, lo que implica tanto potencial como riesgo.

Ponte al día con las últimas herramientas de desarrollo y arquitecturas

Xcode agéntico, Foundation Models, Liquid Glass... el mundo del desarrollo Apple no para. En Be Native tienes todo lo que necesitas para estar al día.

Cuando Apple te abre la puerta de su casa

Permitidnos ahora un momento de orgullo y agradecimiento. Porque estas últimas semanas hemos tenido el privilegio de vivir algo muy especial.

El pasado 2 de febrero, Julio César Fernández, Arturo Rivas, Jon Ander Orcera y Alejandro Mohamad, en representación de Apple Coding y AC Academy, asistieron a una charla sobre Liquid Glass en el Impact Hub de Madrid. La sesión estaba enmarcada dentro del programa “Meet with Apple”, la serie mundial de actividades de diseño que Apple está organizando hasta marzo de 2026 para ayudar a los desarrolladores a adoptar su nuevo lenguaje de diseño.

La charla fue impartida por Aniket Roy, Design Evangelist de Apple, que desgranó las claves del sistema de diseño Liquid Glass —el mayor cambio visual de las plataformas Apple desde iOS 7— y cómo los desarrolladores pueden integrar sus principios en sus aplicaciones. Una sesión inspiradora que dejó claro que Apple sigue apostando por el diseño como piedra angular de la experiencia de usuario. Las APIs de SwiftUI como glassEffect, GlassEffectContainer y glassEffectID permiten que las apps que usan componentes estándar obtengan soporte de Liquid Glass con un esfuerzo mínimo, pero el diablo está en los detalles y en los casos personalizados, que es precisamente lo que estas sesiones presenciales ayudan a resolver.

Pero la cosa no quedó ahí. Julio tuvo además la oportunidad de participar en un workshop técnico de dos días sobre Foundation Model Framework, impartido por Alberto Ricci, Technology Evangelist de Apple desde 2008 —una auténtica leyenda del evangelismo técnico—. Con un enfoque completamente práctico, Alberto guió a más de 20 desarrolladores Apple a través de un caso real de programación que fue mucho más allá de lo esperado: no solo el Foundation Model Framework en sí, sino también transcripción en tiempo real, generación de imágenes, escaneado con reconocimiento de texto y muchas más capacidades de inteligencia artificial on-device. Dos días intensos donde quedó demostrado que la IA de Apple no es un juguete: es una herramienta seria, potente y lista para producción.

Desde aquí queremos dar las gracias de corazón a Annikki Laine, Partnership Manager de Worldwide Developer Relations para Northern Europe en Apple, que desde Helsinki hace posible que estas actividades lleguen a desarrolladores de toda Europa, y a todo el equipo de Apple Developer Relations por abrirnos las puertas. Momentos así nos recuerdan por qué amamos esta comunidad.

OpenClaw: la langosta que incendió internet

Y hablando de comunidad, imposible no hablar del fenómeno que ha sacudido el mundo tech estas semanas: OpenClaw. Aunque para entender la historia completa hay que rebobinar un poco.

Todo empezó con Clawdbot, un “proyecto de fin de semana” de Peter Steinberger —sí, el fundador de PSPDFKit, uno de los nombres más reconocidos del ecosistema iOS que vendió su empresa tras una inversión de 116 millones de dólares de Insight Partners—. La idea era simple y ambiciosa a partes iguales: un agente de IA autónomo, open source, que se ejecuta en tu máquina y se conecta a tus apps del día a día. WhatsApp, Slack, Discord, iMessage, Telegram, Signal, tu email, tu calendario, tu terminal... Clawdbot podía gestionarlo todo. En una entrevista con The Pragmatic Engineer, Steinberger soltó la frase que se hizo viral: “Publico código que no leo”. Solo en enero de 2026 hizo más de 6.600 commits. Él solo. Desde su casa.

El nombre “Clawd” era un guiño evidente a Claude de Anthropic. Y claro, Anthropic no tardó en llamar a la puerta con una reclamación de marca registrada. Steinberger preguntó si podía simplemente quitar la “d” y dejarlo en “Clawbot”. La respuesta: “No permitido”. Así que lo renombró a Moltbot. Y aquí viene la parte buena: en los diez segundos que pasaron entre soltar el nombre viejo en GitHub y Twitter y registrar el nuevo, estafadores de criptomonedas se apoderaron de ambas cuentas antiguas. El caos fue absoluto.

Tras 48 horas de confusión bajo el nombre Moltbot (que “nunca terminó de sonar bien”, admitió Steinberger), nació definitivamente OpenClaw, con una langosta como mascota y la determinación de que este sería el nombre definitivo.

Los números son de vértigo: de 9.000 a 157.000 estrellas en GitHub en 60 días. 34.168 estrellas en solo 48 horas. Es el repositorio de crecimiento más rápido de la historia de la plataforma, 18 veces más rápido que Kubernetes. De él surgió incluso Moltbook, una red social para bots de IA donde los agentes de los usuarios publicaban contenido, comentaban y votaban entre ellos. Llegó a tener 1,5 millones de agentes registrados. Andrej Karpathy (ex-director de IA en Tesla) lo calificó como “lo más cercano a la ciencia ficción que he visto en mucho tiempo”.

Las capacidades son reales e impresionantes: agentes que te preparan briefings matutinos personalizados, gestión de email y calendario por mensaje, scaffolding de proyectos completos, revisión de pull requests desde el móvil, monitorización de grupos de WhatsApp con reconocimiento facial... La lista de lo que la comunidad está construyendo con OpenClaw es interminable, con cientos de skills en su marketplace ClawHub.

Pero —y es un pero muy importante— nosotros lo estamos usando y sabemos de primera mano que hay que tener muchísimo cuidado. Se ha descubierto una vulnerabilidad crítica (CVE-2026-25253, puntuación CVSS de 8.8) que permite ejecución remota de código con un solo clic. Investigadores de seguridad han encontrado 341 skills maliciosos en ClawHub —335 de ellos de una misma campaña—. Snyk analizó casi 4.000 skills y encontró que el 7,1% contenía fallos críticos que exponían credenciales. Los ataques de prompt injection pueden secuestrar tu agente a través de algo tan inocente como un documento de Google. Y no hay sandboxing por defecto.

OpenClaw es una herramienta increíblemente potente. Pero si no eres alguien con experiencia técnica sólida y no entiendes los riesgos que conlleva dar a un agente de IA acceso a tu vida digital, puede convertirse en una pesadilla de seguridad. The Register lo calificó de “incendio en un contenedor de basura” en materia de seguridad. XDA publicó un artículo titulado “Por favor, dejad de usar OpenClaw”. Usadlo, pero con mucho, mucho respeto. Y si lo hacéis, revisad cada skill que instaléis, activad el sandboxing, y no le deis permisos que no entendáis.

Comienza a aprender tu nueva carrera de programación potenciada con IA

El desarrollo de software ha cambiado para siempre. En Be Native te preparamos para dominar las herramientas que están redefiniendo la profesión.

Swift conquista nuevos territorios

Mientras el mundo de la IA ardía, Swift seguía avanzando con paso firme en múltiples frentes.

Windows es territorio Swift

El 26 de enero, el proyecto Swift anunció oficialmente el Windows Workgroup, un grupo de trabajo dedicado a garantizar el soporte continuo de Swift en Windows. El objetivo: mejorar la distribución oficial, adaptar paquetes core como Foundation y Dispatch a las convenciones de Windows, y establecer buenas prácticas para conectar Swift con la API nativa del sistema operativo de Microsoft. Swift va muy en serio con lo de ser multiplataforma.

Swift 6.3 asoma la cabeza

Swift 6.3 sigue su camino hacia una release en primavera de 2026, con mejoras importantes en Embedded Swift: impresión de punto flotante, el atributo @c (SE-0495) para funciones compatibles con C, depuración mejorada en LLDB, análisis de core dumps, y los atributos @section, @used y @export. Además, el Android Workgroup avanza con builds diarios, y hay soporte en preview para FreeBSD 14.3+. El lenguaje sigue expandiéndose a territorios que hace pocos años habrían parecido ciencia ficción.

Evolución en marcha

Varias propuestas de Swift Evolution están en revisión activa:

SE-0506: Advanced Observation Tracking, que mejora los tipos

@Observablecon un control más granular sobre la detección de cambios en propiedades. Muy útil para infraestructura de middleware y sistemas de widgets.SE-0507: Borrow and Mutate Accessors, que permite acceso directo a propiedades sin el overhead de copia. Un paso importante para el rendimiento.

SE-0504: Task Cancellation Shields, que introduce un mecanismo para “proteger” cierto código de limpieza de la cancelación de tareas. Autoría de Konrad Malawski.

Librerías C más cómodas en Swift

Un post imperdible de Doug Gregor en swift.org explica cómo hacer librerías C más ergonómicas en Swift usando API notes: archivos YAML que se superponen sobre las cabeceras C para obtener enums nativos, gestión automática de memoria con SWIFT_SHARED_REFERENCE, firmas idiomáticas con SWIFT_NAME y seguridad de tipos con OptionSet. Todo sin tocar una línea del código C original. Incluye un script Swift para generar las API notes automáticamente. Brillante.

Tu iPhone piensa, pero no te espía

El Foundation Models Framework de Apple sigue ganando tracción entre los desarrolladores. Hablamos de un modelo de 3.000 millones de parámetros ejecutándose completamente en el dispositivo: sin enviar datos a la nube, sin costes adicionales, funcionando incluso offline. Con tan solo tres líneas de código Swift puedes acceder a capacidades de resumen, extracción de entidades, generación de texto creativo, diálogo corto y mucho más. Apple ha publicado nuevos tutoriales sobre prompting de Foundation Models y un code-along oficial que merece mucho la pena.

Radar de la comunidad

El Swift Student Challenge 2026 tiene las inscripciones abiertas del 6 al 28 de febrero. Los Distinguished Winners serán invitados a Cupertino este verano.

El 10 de febrero, Apple organiza desde Cupertino un día completo de sesiones fundacionales de SwiftUI con livestream.

Studioworks comparte su caso de éxito construyendo aplicaciones web completas en Swift con Hummingbird 2, Soto y Elementary, logrando tiempos de carga por debajo de 100ms.

Nuevos paquetes destacados: Cadova (herramienta de CAD 3D programable), Feather Database (capa de base de datos agnóstica con concurrencia Swift), y MailFoundation (port de librerías de correo de .NET).

Y poco más

Han sido unas semanas de vértigo. Apple abrazando la IA agéntica en Xcode, dos gigantes lanzando modelos el mismo día, una langosta sembrando el caos en GitHub, y nosotros teniendo el privilegio de aprender de primera mano con los evangelistas de Apple en Madrid. Si algo queda claro es que 2026 no va a dar tregua. Y sinceramente, no querríamos que la diera.

Si queréis dejarnos un comentario o contarnos cualquier cosa, estamos en los canales habituales.

Nos leemos pronto y hasta entonces: un saludo y Good Apple Coding.

¡Gracias por leer nuestra Newsletter! Nos vemos en Be Native.

]]>Diciembre toca a su fin y con él se cierra un 2025 que, sin exagerar, ha sido uno de los años más transformadores para el ecosistema Apple y el desarrollo en Swift. Un año donde Apple decidió que los números de versión aburrían y que mejor nos sincronizábamos todos con el calendario; donde el diseño de nuestras apps se volvió líquido —literalmente—; y donde la inteligencia artificial pasó de ser una promesa a convertirse en nuestro compañero de código diario.

Antes de que os lancéis a las uvas, os invitamos a escuchar el podcast especial de fin de año en Apple Coding, donde repasamos todo esto y más con el detalle y el cariño que se merece. Pero si preferís la versión escrita, poneos cómodos: vamos a recorrer este 2025 mes a mes.

Enero-Febrero: El despertar de los agentes

El año comenzó con el ecosistema Swift asimilando las novedades de Swift 6, lanzado en septiembre de 2024. La adopción del nuevo modelo de concurrencia estricta generaba debates acalorados en los foros, mientras los desarrolladores descubrían que migrar sus proyectos no era tan trivial como esperaban. Los warnings de Sendable se convirtieron en el pan de cada día.

Pero febrero trajo la primera gran bomba del año: Anthropic lanzó Claude Code el 24 de febrero, junto con Claude 3.7 Sonnet. Por primera vez, teníamos un agente de IA que vivía directamente en nuestra terminal, entendía nuestro código base y podía ejecutar tareas complejas mediante comandos en lenguaje natural. No era solo autocompletado glorificado: era un compañero que podía hacer commits, gestionar ramas de Git y refactorizar código mientras tomabas café.

Mientras tanto, Apple preparaba silenciosamente la expansión de Apple Intelligence a más idiomas y regiones, anunciando que en abril llegaría a nuevos mercados.

Marzo: Swift 6.1 y la IA llega a Europa

Marzo fue un mes de consolidación. Swift 6.1 vio la luz junto con Xcode 16.3, trayendo mejoras incrementales pero necesarias en el sistema de concurrencia y correcciones de bugs que la comunidad llevaba meses reportando.

El 31 de marzo, Apple Intelligence por fin llegó a la Unión Europea en iPhones y iPads, y también se expandió a Apple Vision Pro en inglés estadounidense. Los europeos por fin podíamos probar las herramientas de escritura, los resúmenes de notificaciones y las funciones de Siri mejoradas que nuestros colegas americanos llevaban disfrutando desde el año anterior.

También se formalizó el Testing Workgroup, un grupo dedicado a mejorar el estado del testing en Swift. Su primera reunión oficial fue el 10 de marzo, sentando las bases para las mejoras en Swift Testing que veríamos más adelante.

Y Apple anunció oficialmente que la WWDC 2025 tendría lugar del 9 al 13 de junio, generando las primeras especulaciones sobre iOS 19 —aunque el número acabaría siendo muy diferente—.

Abril-Mayo: Los requisitos suben y los agentes de OpenAI despiertan

Abril trajo cambios importantes para los desarrolladores: a partir de ese mes, todas las apps subidas a App Store Connect debían compilarse con los SDKs de iOS 18, iPadOS 18, tvOS 18, visionOS 2 o watchOS 11. Adiós a seguir compilando con versiones antiguas; Apple empujaba a todos hacia adelante.

En mayo, OpenAI lanzó Codex en research preview, su agente de ingeniería de software basado en la nube. A diferencia de Claude Code, Codex funcionaba de forma asíncrona: le asignabas tareas y él trabajaba en paralelo, permitiendo lanzar múltiples agentes simultáneamente para escribir features, corregir bugs y proponer pull requests. Estaba potenciado por codex-1, una versión de o3 optimizada específicamente para tareas de programación.

El 3 de junio, Codex llegó a los usuarios de ChatGPT Plus, democratizando el acceso a agentes de código más allá de las APIs para desarrolladores.

También en mayo, GitHub anunció su coding agent en Microsoft Build, integrando capacidades agénticas directamente en GitHub y VS Code. El panorama de los asistentes de código se estaba transformando a velocidad de vértigo.

Junio: WWDC 2025 y el cristal líquido que lo cambió todo

Y llegó junio. Y la WWDC. Y nada volvió a ser igual.

“Sleek peek” fue el eslogan de la WWDC 2025, celebrada del 9 al 13 de junio con formato híbrido: evento presencial en Apple Park y sesiones online para el resto del mundo. Pero nadie estaba preparado para lo que Apple tenía guardado.

iOS 26: el número que nadie esperaba

La primera sorpresa llegó con los números de versión: Apple abandonó el sistema incremental y pasó a usar el año como número de versión. Así que no hubo iOS 19: en su lugar, llegó iOS 26. Y macOS 26. Y watchOS 26. Y visionOS 26. Todos sincronizados con el calendario. Un cambio que generó debates intensos pero que, hay que admitirlo, tiene su lógica.

Liquid Glass: el diseño se vuelve fluido

Pero el verdadero protagonista fue Liquid Glass, el nuevo sistema de diseño que redefinía la interfaz de todos los sistemas operativos de Apple. Translucidez, profundidad, elementos que fluyen y se adaptan. La belleza del asunto para los desarrolladores de SwiftUI: simplemente recompilando con Xcode 26, las apps adoptaban automáticamente el nuevo aspecto. Para quienes querían más control, llegaron nuevas APIs como glassEffect(_:in:isEnabled:).

Apple dio un año de gracia para que las apps pudieran seguir usando el diseño tradicional si lo necesitaban, pero el mensaje estaba claro: el futuro es líquido.

Swift 6.2: WebAssembly, subprocesos y más

Swift 6.2 se anunció en la WWDC, trayendo novedades suculentas:

Soporte para WebAssembly (Wasm): por fin podíamos compilar Swift para el navegador y otros entornos Wasm con soporte oficial.

El nuevo paquete Subprocess: una API moderna y orientada a concurrencia para lanzar y gestionar procesos externos.

Inline Arrays: arrays de tamaño fijo con optimizaciones en tiempo de compilación.

Aislamiento al main actor por defecto: una opción que reduce dramáticamente el boilerplate en código concurrente.

Extensión oficial de Swift para VS Code: verificada y distribuida por Swift.org, con indexación en segundo plano y debugging integrado con LLDB.

SwiftUI: más poder que nunca

SwiftUI recibió una actualización masiva:

WebView nativo: por fin podíamos cargar y mostrar webs directamente en SwiftUI sin depender de UIKit.

TextEditor con texto enriquecido: edición de rich text nativa con controles personalizables.

Charts 3D: la nueva API Chart3D para gráficos tridimensionales interactivos.

Integración profunda con RealityKit: nuevos componentes que mezclan SwiftUI y 3D de forma natural.

Mejoras para iPadOS: barra de menú con swipe hacia abajo y ventanas redimensionables de forma más fluida.

Foundation Models Framework

Una de las novedades más significativas fue el Foundation Models Framework, que permite a los desarrolladores acceder directamente al modelo fundacional on-device de Apple Intelligence. Inferencia gratuita, privada, offline. Un movimiento que democratiza el acceso a la IA sin depender de APIs externas ni comprometer la privacidad del usuario.

Julio-Agosto: El verano del crecimiento

El verano fue de consolidación. Claude Code creció 10x en usuarios desde su lanzamiento más amplio en mayo, demostrando que los desarrolladores estaban hambrientos de herramientas agénticas que realmente funcionaran.

La comunidad empezó a explorar las posibilidades del Foundation Models Framework, aparecieron los primeros tutoriales, y los foros se llenaron de discusiones sobre cómo aprovechar Liquid Glass sin romper la experiencia de usuario.

El Testing Workgroup continuó su trabajo, preparando las mejoras de output para Swift Testing que llegarían a través del programa GSoC (Google Summer of Code), con un nuevo sistema de reportes jerárquicos mucho más legible.

Septiembre: iPhone Air, iOS 26 para todos y Swift 6.2 oficial

Septiembre es siempre el mes grande para Apple, y este año no decepcionó.

iPhone 17 y el inesperado iPhone Air

El 9 de septiembre, en el evento “Awe Dropping” celebrado en Apple Park, Apple presentó su nueva línea de iPhone:

iPhone 17 (799$): con pantalla mejorada con ProMotion y chip A19.

iPhone 17 Pro (1.099$): salto de precio pero con 256GB de base y el potente A19 Pro.

iPhone 17 Pro Max (1.199$): el buque insignia con la mejor cámara y batería.

iPhone Air (999$): la gran sorpresa. Con solo 5.6mm de grosor, el iPhone más fino jamás creado. Cuerpo de titanio, diseño que recuerda al mítico iPod nano, y un mensaje claro de que Apple sabe hacer dispositivos delgados cuando quiere.

El iPhone Air no se llama “iPhone 17 Air” —simplemente iPhone Air—, lo que sugiere que podría convertirse en una línea permanente.

iOS 26 para todos

El 15 de septiembre, coincidiendo con la disponibilidad de los nuevos iPhone, iOS 26 llegó al público general. Liquid Glass transformó millones de dispositivos de la noche a la mañana.

Swift 6.2 oficial

El mismo día, Swift 6.2 se publicó oficialmente, trayendo todas las mejoras anunciadas en la WWDC a producción.

Claude Code 2.0

Anthropic lanzó la versión 2.0 de Claude Code en septiembre, con:

Extensión nativa para VS Code: integración directa sin salir del editor.

Sistema de checkpoints: guardado automático del estado del código antes de cada cambio, con la posibilidad de hacer rollback instantáneo con Esc-Esc o

/rewind.Potenciado por Sonnet 4.5: capacidad para manejar tareas de desarrollo más largas y complejas.

Foundation Models Framework disponible

El framework anunciado en junio se hizo disponible con iOS 26, permitiendo a los desarrolladores crear experiencias inteligentes on-device sin coste de inferencia.

Octubre: Vision Pro con M5 y Codex para todos

Octubre trajo actualizaciones importantes en hardware y software.

Apple Vision Pro con M5

El 15 de octubre, Apple anunció una actualización significativa de Vision Pro con el nuevo chip M5:

10% más de píxeles renderizados en las pantallas micro-OLED.

Hasta 120Hz de refresco para una experiencia más suave.

Neural Engine 16 núcleos: funciones de IA hasta 50% más rápidas.

Batería mejorada: 2.5 horas de uso general, 3 horas de vídeo.

Dual Knit Band: nueva banda que distribuye mejor el peso y reduce la fatiga.

El precio se mantuvo en 3.499$, y las ventas comenzaron el 22 de octubre.

M5 también en MacBook Pro

El MacBook Pro de 14 pulgadas de entrada recibió el chip M5, aunque Apple no actualizó los modelos Pro/Max ni el Mac mini este año —eso queda para 2026—.

Codex general availability

El 6 de octubre, OpenAI anunció la disponibilidad general de Codex, junto con integración con Slack. También llegó GPT-5-Codex, una versión de GPT-5 optimizada específicamente para tareas agénticas de ingeniería de software.

Claude Code para web

El 20 de octubre, Anthropic lanzó Claude Code para web, permitiendo gestionar múltiples agentes de código desde el navegador. Disponible para suscriptores Pro (20$/mes) y Max (100$/200$/mes), representaba la evolución natural de la herramienta de terminal hacia un entorno más visual y accesible.

Noviembre-Diciembre: El cierre del año

Los últimos meses del año fueron de consolidación y preparación para 2026.

GitHub Copilot siguió evolucionando: en noviembre llegaron los controles de políticas para agent mode, y en diciembre se lanzaron los Agent Skills, que permiten enseñar a Copilot a realizar tareas especializadas de forma repetible.

Swift continuó su expansión multiplataforma: el trabajo en Android avanza con builds diarios y demos end-to-end, Windows madura con mejor soporte de VS Code, y FreeBSD 14.3 recibió un preview de soporte oficial.

La comunidad Swift digirió todas las novedades del año, Liquid Glass se convirtió en la nueva normalidad, y los agentes de IA —Codex, Claude Code, Copilot— se integraron en el flujo de trabajo de desarrolladores de todo el mundo.

OpenAI cerró el año con GPT-5.2-Codex, presumiendo de ser el modelo de codificación más avanzado, con mejoras en trabajos de larga duración, refactorizaciones masivas y capacidades de ciberseguridad.

Y poco más

Qué año, ¿verdad? De Swift 6 luchando por la adopción a Swift 6.2 con WebAssembly. De iOS 18 a iOS 26 sin pestañear. De herramientas de autocompletado a agentes autónomos que programan mientras dormimos. El desarrollo ha cambiado para siempre y ahora más que nunca se pide algo claro: especialización. Por eso hemos re-definido nuestra formación estrella Swift Mastery Program, para dar lo que se necesita: conocimiento y uso de herramientas de IA. No hay otra combinación para garantizar tu futuro.

El desarrollo Apple en 2025 ha sido una montaña rusa de innovación: Liquid Glass redefinió cómo lucen nuestras apps, Foundation Models democratizó la IA on-device, y los agentes de código —Claude Code, Codex, Copilot— transformaron para siempre cómo escribimos software.

No olvidéis escuchar el podcast especial de fin de año en Apple Coding, donde profundizamos en todo esto con más detalle y debate.

¿Qué nos deparará 2026? Rumores de Apple Glasses, un Mac mini con M5, el Siri mejorado que Apple prometió y no entregó este año... Las expectativas son altas, pero si algo hemos aprendido en 2025, es que Apple siempre tiene alguna sorpresa guardada.

Si queréis dejarnos un comentario o contarnos cualquier cosa, estamos en los canales habituales.

Nos leemos en 2026 y hasta entonces: feliz año nuevo y buen código nativo.

¡Gracias por leer nuestra Newsletter! Nos vemos en Be Native.

]]>Cerramos 2025 con una semana que pasará a la historia. Swift cumple una década como proyecto de código abierto, Apple publica investigación que convierte fotos en mundos 3D en menos de un segundo, los videojuegos reciben un tratamiento de primera clase con una jornada completa de formación desde Cupertino, y Japón se une al club de países donde el iPhone permite tiendas de apps alternativas. Una semana intensa, de esas que te recuerdan por qué seguimos aquí.

Una década de código abierto

El 19 de diciembre se publicó el tradicional recap mensual de Swift, pero esta vez venía cargado de nostalgia. Hace exactamente diez años, Apple anunciaba que Swift se convertía en software de código abierto. Lo que comenzó como un experimento ha crecido hasta convertirse en un ecosistema de más de 70 repositorios con cientos de contribuyentes semanales.

El recap destaca los hitos del año: Swift 6.2 con su concurrencia más accesible, soporte para WebAssembly, interoperabilidad profunda con C++, y las mejoras en seguridad de memoria que están redefiniendo lo que significa escribir código seguro.

Pero quizá lo más llamativo es la expansión a nuevas plataformas. Swift ya no es solo el lenguaje de Apple: corre en Android, Windows, FreeBSD, sistemas embebidos, y hasta en un Pebble Time Round de hace diez años. El proyecto ha madurado hasta el punto de que Amazon ha anunciado soporte integrado en Amazon Linux y adopción oficial del AWS Lambda Runtime.

En el frente de Swift Evolution, tres propuestas merecen atención:

SE-0497: Control de visibilidad de definiciones de funciones (completada)

SE-0493: Permite llamadas

asyncen cuerposdefer(completada)SE-0501: Reportes de cobertura HTML para Swift Package Manager (en revisión)

Y hablando de expansión, el 18 de diciembre se publicó Exploring the Swift SDK for Android, donde se anuncian los nuevos previews de Swift 6.3 con compilaciones diarias del SDK para Android. El SDK ahora soporta múltiples niveles de API de Android usando el familiar atributo @available y verificaciones #available, exactamente igual que en plataformas Apple. Apps como Spark, flowkey, MediQuo y Naturitas ya funcionan en producción con millones de descargas.

De una foto a un mundo

Si hay algo que ha incendiado las redes esta semana, es SHARP. El 17 de diciembre, Apple publicó investigación que parece magia: un modelo que reconstruye escenas 3D fotorrealistas a partir de una única fotografía en menos de un segundo.

SHARP (Sharp Monocular View Synthesis) utiliza Gaussian Splatting —millones de pequeños bloques de color y luz posicionados en el espacio— para recrear la escena. A diferencia de métodos anteriores que requerían docenas o cientos de imágenes desde diferentes ángulos, SHARP lo logra en un único paso de red neuronal.

Los números son impresionantes:

Tiempo de síntesis: 3 órdenes de magnitud más rápido que modelos anteriores

Renderizado: más de 100 FPS en GPU estándar

LPIPS: mejora del 25-34%

DISTS: mejora del 21-43%

La comunidad no ha tardado en experimentar. Un usuario compartió:

“Acabo de ejecutar SHARP localmente y vi mis fotos convertirse en Gaussian Splats en segundos, luego entré en ellas con Vision Pro”

El modelo tiene sus limitaciones —solo puede reconstruir vistas cercanas al punto original, no puede “inventar” lo que no ve— pero las implicaciones para Vision Pro y experiencias inmersivas son enormes. Y lo mejor: Apple lo ha publicado como código abierto en GitHub.

Pero SHARP no viene solo. El 16 de diciembre se presentó UniGen-1.5, un modelo multimodal que hace algo que hasta ahora requería tres modelos diferentes: entender, generar y editar imágenes. Un único modelo para todo.

La innovación clave es Edit Instruction Alignment, un nuevo paso de post-entrenamiento que alinea las instrucciones de edición con la semántica de la imagen objetivo. En benchmarks, UniGen-1.5 alcanza 0.89 en GenEval y 86.83 en DPG-Bench, superando a modelos recientes como BAGEL y BLIP3o. En edición de imágenes, su puntuación de 4.31 en ImgEdit es comparable a modelos propietarios como GPT-Image-1.

Y no olvidemos BED-LLM (19 dic), que propone usar diseño experimental bayesiano para que los LLMs recopilen información de forma más inteligente, y DarkDiff (16 dic), que aplica modelos de difusión para mejorar la fotografía en condiciones de luz extremadamente baja. Apple no solo está investigando: está definiendo el futuro.

Aprende de los que saben

Si 2025 te pilló sin tiempo para formarte, 2026 puede ser tu año. El Swift Mastery Program 2026 ya acepta inscripciones: una formación intensiva donde no solo aprenderás las herramientas, sino que entenderás el porqué detrás de cada decisión.

En un mundo donde los agentes de IA generan código con facilidad, quien entiende los fundamentos siempre estará un paso por delante. El SMP no es un curso más: es el programa que te convertirá en el desarrollador que las empresas necesitan, capaz de supervisar, corregir y dirigir el código que generan las máquinas.

Press Start: Apple se pone seria con los juegos

Si desarrollas videojuegos —o alguna vez lo has considerado—, esta semana ha sido un festín. Apple ha publicado Press Start: Game development on Apple platforms, una jornada completa de formación retransmitida desde el Developer Center de Cupertino.

La sesión principal, disponible en Apple Developer Videos, incluye charlas sobre:

Traza la ruta de tu juego hacia las plataformas Apple (18:26)

Sube de nivel con las tecnologías de juegos de Apple (19:17)

Trae tus juegos de PC y consola a Mac (19:53)

Diseña grandes interfaces para juegos portátiles (19:59)

Explora potencia, rendimiento y escalabilidad en iPhone/iPad (15:43)

Transforma tu juego con Apple Vision Pro (27:33)

Además, hay un caso de estudio fascinante: Descubre cómo DREDGE fue reimaginado para las plataformas Apple con Black Salt Games, donde cuentan cómo adaptaron su éxito indie —ganador del App Store Award 2025— a los dispositivos Apple.

Pero el contenido no es lo único nuevo. La página What’s New de Games revela las novedades técnicas:

Metal 4 llega con una API optimizada para Apple Silicon, menor overhead en codificación de comandos, y algo que cambia las reglas: soporte nativo para Machine Learning con tensores directamente en el lenguaje de shaders. Ahora puedes ejecutar redes neuronales grandes o hacer inferencia inline en tus shaders.

Game Porting Toolkit 3 amplía el conjunto de instrucciones soportadas, mejora los sparse resources, añade soporte para MetalFX (upscaling, denoising, frame interpolation), y permite debugging remoto desde Visual Studio en Mac.

El nuevo GameSave Framework sincroniza automáticamente los datos de guardado entre iPhone, iPad, Mac y Apple Vision Pro. Tus jugadores podrán continuar la partida donde la dejaron, en cualquier dispositivo.

Y la estrella: Apple Games app, una nueva aplicación unificada que viene preinstalada y sirve como destino único para descubrir, lanzar y jugar. Los juegos aparecen automáticamente, con integración de Game Center e In-App Events.

Para los que trabajan con realidad virtual, hay soporte para el PlayStation VR2 Sense controller en visionOS con 6 grados de libertad y vibración. Y si desarrollas para pantallas táctiles, la nueva On-screen controls API facilita crear controles táctiles nativos para iPhone e iPad.

Liquid Glass para todos

Adaptar tu app al nuevo lenguaje de diseño de Apple no tiene por qué ser un salto al vacío. Esta semana se han publicado varios showcases donde desarrolladores reales cuentan cómo lo han hecho:

Showcase: Apps integrating Liquid Glass (116:17) — Lowe’s, American Airlines y Sky Guide comparten sus experiencias, seguidos de una charla con líderes del equipo de diseño de Apple.

Liquid Glass showcase: CNN (9:24)

Liquid Glass showcase: Slack (12:28)

Liquid Glass showcase: Tide Guide (10:52)

Liquid Glass showcase: LTK (9:33)

Y si prefieres aprender haciendo, el Code-along: Start building with Swift and SwiftUI (96:09) te guía paso a paso para construir una interfaz iOS completa usando SwiftUI y SwiftData.

De Tokio al mundo

El 17 de diciembre, Apple anunció cambios significativos en iOS para Japón. Para cumplir con la Ley de Competencia de Software Móvil (MSCA), a partir de iOS 26.2 los desarrolladores en Japón pueden:

Distribuir apps en marketplaces alternativos

Operar sus propios marketplaces

Procesar pagos de bienes y servicios digitales fuera de Apple In-App Purchase